| 经典backbone | 您所在的位置:网站首页 › vwhgg › 经典backbone |

经典backbone

|

VGG你都不知道?你自己走还是我送你?

VGG16

简介

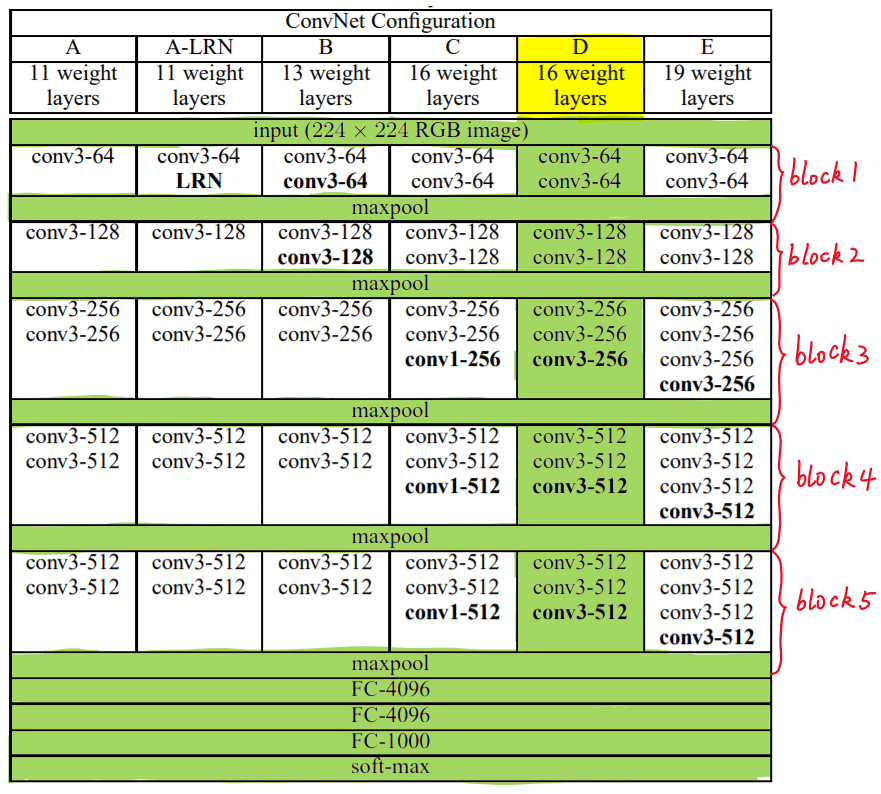

VGG是由Simonyan 和Zisserman在文献《Very Deep Convolutional Networks for Large Scale Image Recognition》中提出卷积神经网络模型,其名称来源于作者所在的牛津大学视觉几何组(Visual Geometry Group)的缩写。 该模型参加2014年的 ImageNet图像分类与定位挑战赛,取得了优异成绩:在分类任务上排名第二,在定位任务上排名第一。 结构VGG中根据卷积核大小和卷积层数目的不同,可分为A,A-LRN,B,C,D,E共6个配置(ConvNet Configuration),其中以D,E两种配置较为常用,分别称为VGG16和VGG19。 下图给出了VGG的六种结构配置:

上图中,每一列对应一种结构配置。例如,图中绿色部分即指明了VGG16所采用的结构。 我们针对VGG16进行具体分析发现,VGG16共包含: 13个卷积层(Convolutional Layer),分别用conv3-XXX表示 3个全连接层(Fully connected Layer),分别用FC-XXXX表示 5个池化层(Pool layer),分别用maxpool表示其中,卷积层和全连接层具有权重系数,因此也被称为权重层,总数目为13+3=16,这即是 VGG16中16的来源。(池化层不涉及权重,因此不属于权重层,不被计数)。 特点VGG16的突出特点是简单,体现在: 卷积层均采用相同的卷积核参数 卷积层均表示为conv3-XXX,其中conv3说明该卷积层采用的卷积核的尺寸(kernel size)是3,即宽(width)和高(height)均为3,3*3是很小的卷积核尺寸,结合其它参数(步幅stride=1,填充方式padding=same),这样就能够使得每一个卷积层(张量)与前一层(张量)保持相同的宽和高。XXX代表卷积层的通道数。 池化层均采用相同的池化核参数 池化层的参数均为2× 模型是由若干卷积层和池化层堆叠(stack)的方式构成,比较容易形成较深的网络结构(在2014年,16层已经被认为很深了)。 综合上述分析,可以概括VGG的优点为: Small filters, Deeper networks.

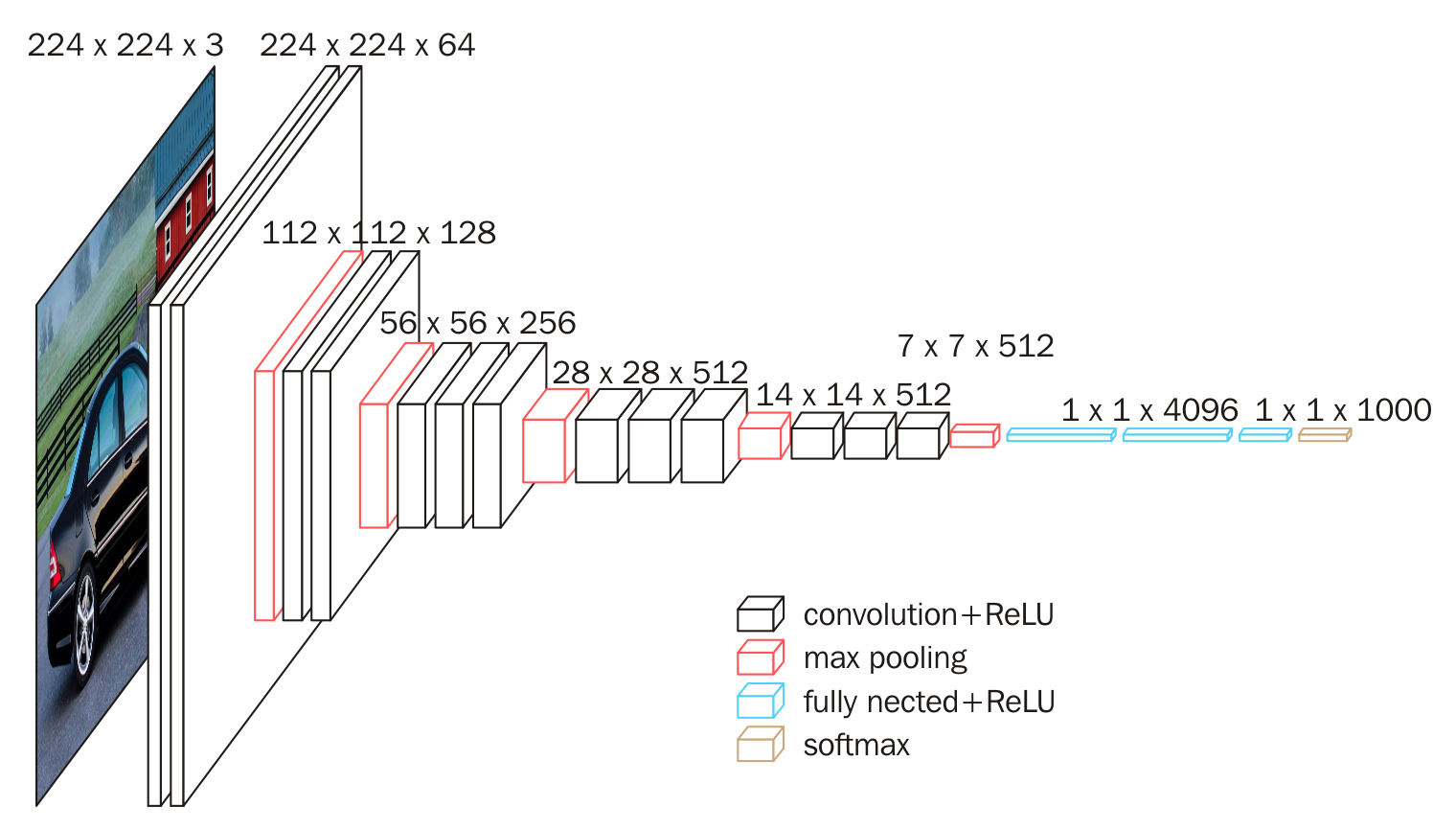

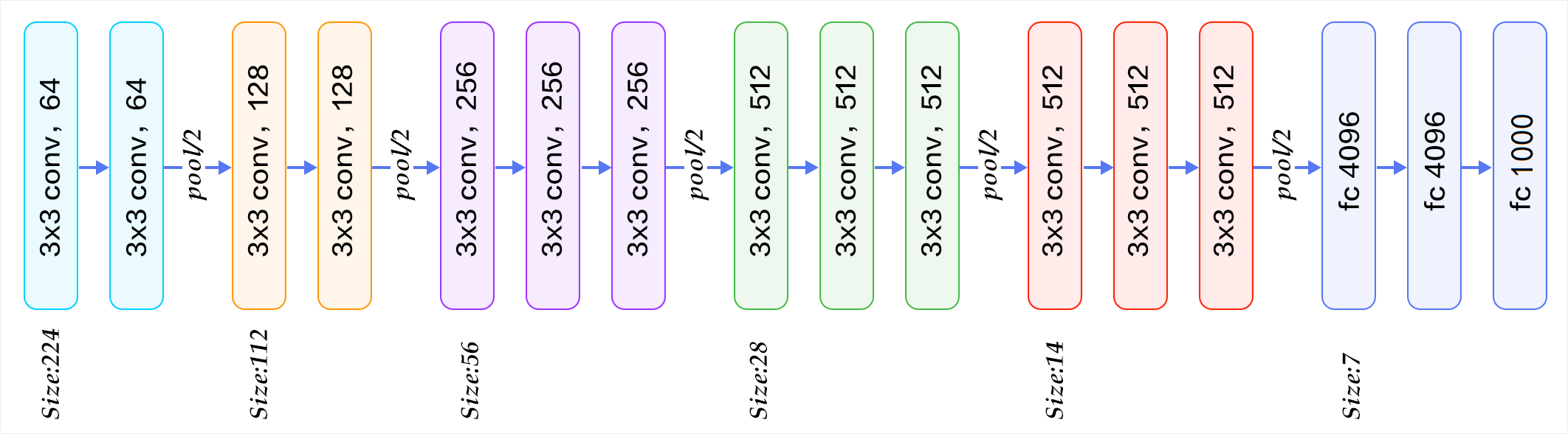

我们注意上图右侧,VGG16的卷积层和池化层可以划分为不同的块(Block),从前到后依次编号为Block1~block5。每一个块内包含若干卷积层和一个池化层。例如:Block4包含: 3个卷积层,conv3-512 1个池化层,maxpool并且同一块内,卷积层的通道(channel)数是相同的,例如: block2中包含2个卷积层,每个卷积层用conv3-128表示,即卷积核为:3x3x3,通道数都是128block3中包含3个卷积层,每个卷积层用conv3-256表示,即卷积核为:3x3x3,通道数都是256 下面给出按照块划分的VGG16的结构图,可以结合图2进行理解:

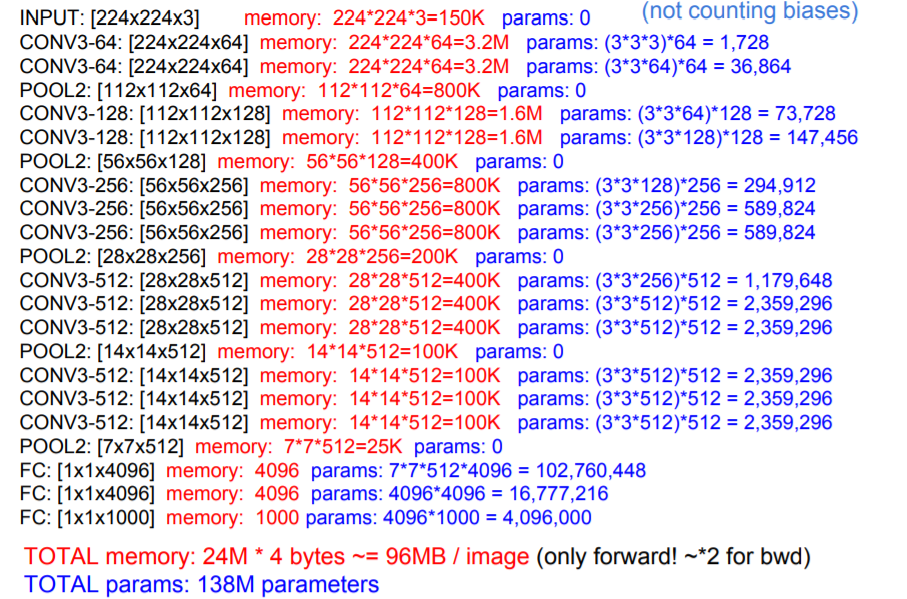

VGG的输入图像是 224x224x3 通道数翻倍,由64依次增加到128,再到256,直至512保持不变,不再翻倍 高和宽变减半,由 224→112→56→28→14→7 权重参数尽管VGG的结构简单,但是所包含的权重数目却很大,达到了惊人的139,357,544个参数。这些参数包括卷积核权重和全连接层权重。 例如,对于第一层卷积,由于输入图的通道数是3,网络必须学习大小为3x3,通道数为3的的卷积核,这样的卷积核有64个,因此总共有(3x3x3)x64 = 1728个参数 计算全连接层的权重参数数目的方法为:前一层节点数×本层的节点数前一层节点数×本层的节点数。因此,全连接层的参数分别为: 7x7x512x4096 = 1027,645,444 4096x4096 = 16,781,321 4096x1000 = 4096000FeiFei Li在CS231的课件中给出了整个网络的全部参数的计算过程(不考虑偏置),如下图所示:

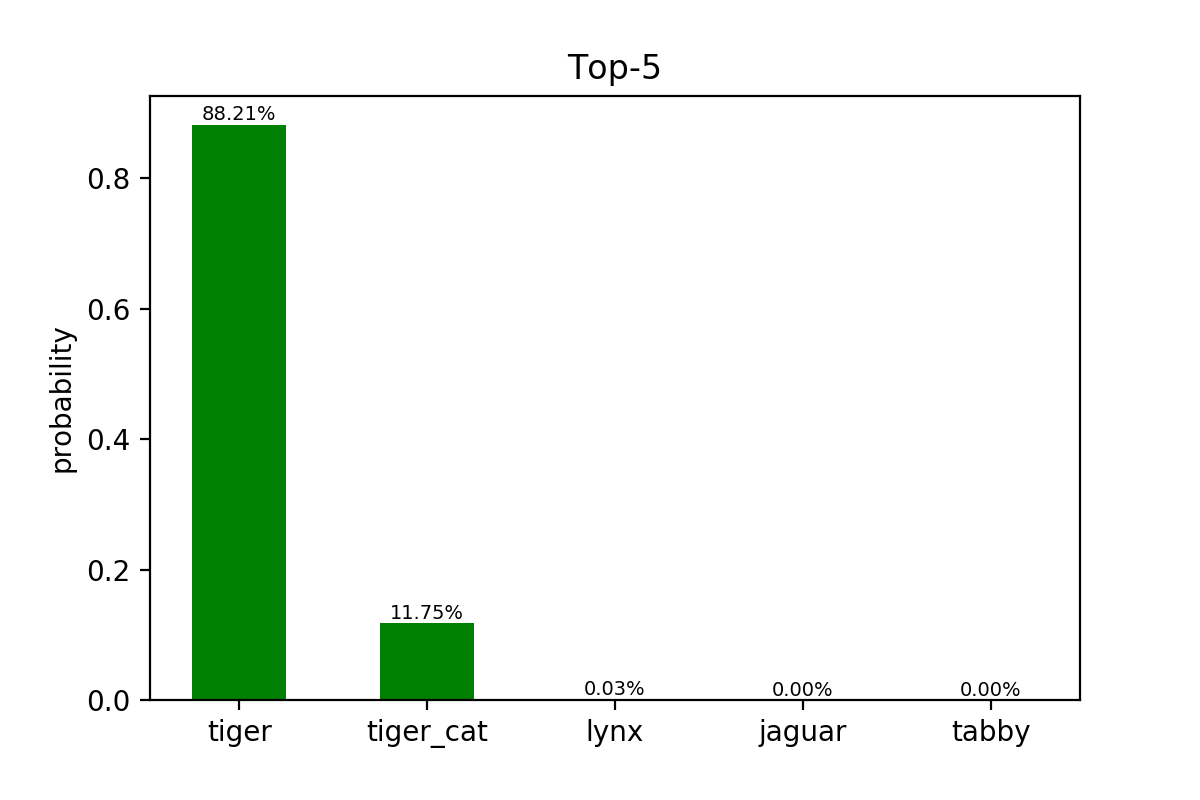

图中蓝色是计算权重参数数量的部分;红色是计算所需存储容量的部分。 VGG16具有如此之大的参数数目,可以预期它具有很高的拟合能力;但同时缺点也很明显: 即训练时间过长,调参难度大。 需要的存储容量大,不利于部署。例如存储VGG16权重值文件的大小为500多MB,不利于安装到嵌入式系统中。 实践下面,我们应用Keras对VGG16的图像分类能力进行试验。 Keras是一个高层神经网络API,Keras由纯Python编写 ,是tensorflow和Theano等底层深度学习库的高级封装 。使用Keras时,我们不需要直接调用底层API构建深度学习网络,仅调用keras已经封装好的函数即可。 基本流程: 载入相关模块,keras ,matplotlib,numpy 下载已经训练好的模型文件: 导入测试图像 应用模型文件对图像分类源代码如下: import matplotlib.pyplot as plt from keras.applications.vgg16 import VGG16 from keras.preprocessing import image from keras.applications.vgg16 import preprocess_input, decode_predictions import numpy as np def percent(value): return '%.2f%%' % (value * 100) # include_top=True,表示會載入完整的 VGG16 模型,包括加在最後3層的卷積層 # include_top=False,表示會載入 VGG16 的模型,不包括加在最後3層的卷積層,通常是取得 Features # 若下載失敗,請先刪除 \.keras\models\vgg16_weights_tf_dim_ordering_tf_kernels.h5 model = VGG16(weights='imagenet', include_top=True) # Input:要辨識的影像 img_path = 'tiger.png' #img_path = 'tiger.jpg' 并转化为224*224的标准尺寸 img = image.load_img(img_path, target_size=(224, 224)) x = image.img_to_array(img) #转化为浮点型 x = np.expand_dims(x, axis=0)#转化为张量size为(1, 224, 224, 3) x = preprocess_input(x) # 預測,取得features,維度為 (1,1000) features = model.predict(x) # 取得前五個最可能的類別及機率 pred=decode_predictions(features, top=5)[0] #整理预测结果,value values = [] bar_label = [] for element in pred: values.append(element[2]) bar_label.append(element[1]) #绘图并保存 fig=plt.figure(u"Top-5 预测结果") ax = fig.add_subplot(111) ax.bar(range(len(values)), values, tick_label=bar_label, width=0.5, fc='g') ax.set_ylabel(u'probability') ax.set_title(u'Top-5') for a,b in zip(range(len(values)), values): ax.text(a, b+0.0005, percent(b), ha='center', va = 'bottom', fontsize=7) fig = plt.gcf() plt.show() name=img_path[0:-4]+'_pred' fig.savefig(name, dpi=200) #输出模型的结构配置 print(model.summary())输出: Model: "vgg16" _________________________________________________________________ Layer (type) Output Shape Param # ================================================================= input_1 (InputLayer) [(None, 224, 224, 3)] 0 _________________________________________________________________ block1_conv1 (Conv2D) (None, 224, 224, 64) 1792 _________________________________________________________________ block1_conv2 (Conv2D) (None, 224, 224, 64) 36928 _________________________________________________________________ block1_pool (MaxPooling2D) (None, 112, 112, 64) 0 _________________________________________________________________ block2_conv1 (Conv2D) (None, 112, 112, 128) 73856 _________________________________________________________________ block2_conv2 (Conv2D) (None, 112, 112, 128) 147584 _________________________________________________________________ block2_pool (MaxPooling2D) (None, 56, 56, 128) 0 _________________________________________________________________ block3_conv1 (Conv2D) (None, 56, 56, 256) 295168 _________________________________________________________________ block3_conv2 (Conv2D) (None, 56, 56, 256) 590080 _________________________________________________________________ block3_conv3 (Conv2D) (None, 56, 56, 256) 590080 _________________________________________________________________ block3_pool (MaxPooling2D) (None, 28, 28, 256) 0 _________________________________________________________________ block4_conv1 (Conv2D) (None, 28, 28, 512) 1180160 _________________________________________________________________ block4_conv2 (Conv2D) (None, 28, 28, 512) 2359808 _________________________________________________________________ block4_conv3 (Conv2D) (None, 28, 28, 512) 2359808 _________________________________________________________________ block4_pool (MaxPooling2D) (None, 14, 14, 512) 0 _________________________________________________________________ block5_conv1 (Conv2D) (None, 14, 14, 512) 2359808 _________________________________________________________________ block5_conv2 (Conv2D) (None, 14, 14, 512) 2359808 _________________________________________________________________ block5_conv3 (Conv2D) (None, 14, 14, 512) 2359808 _________________________________________________________________ block5_pool (MaxPooling2D) (None, 7, 7, 512) 0 _________________________________________________________________ flatten (Flatten) (None, 25088) 0 _________________________________________________________________ fc1 (Dense) (None, 4096) 102764544 _________________________________________________________________ fc2 (Dense) (None, 4096) 16781312 _________________________________________________________________ predictions (Dense) (None, 1000) 4097000 ================================================================= Total params: 138,357,544 Trainable params: 138,357,544 Non-trainable params: 0 _________________________________________________________________ None关于程序运行: 程序运行过程中,语句model = VGG16(weights='imagenet', include_top=True)会下载已经训练好的文件到\.keras\models文件夹下,模型的文件名为vgg16_weights_tf_dim_ordering_tf_kernels.h5,大小为527MB 语句pred=decode_predictions(features, top=5)[0]会下载分类信息文件到\.keras\models文件夹下,模型的文件名为imagenet_class_index.json,该文件指明了ImageNet大赛所用的1000个图像类的信息。(由于下载地址在aws上,梯子请自备) 程序运行结束,会在工作目录下生成测试图片的预测图,给出了最有可能的前5个类列。名称为:测试文件名_pred.png 对如下图像进行分类:

分类结果为:

本文来自博客园,作者:甫生,转载请注明原文链接:https://www.cnblogs.com/fusheng-rextimmy/p/15452248.html |

【本文地址】