| 【精选】【bp预测】基于模拟退火遗传算法优化BP神经网络的钢带厚度预测 | 您所在的位置:网站首页 › 鲸鱼优化bp神经网络python › 【精选】【bp预测】基于模拟退火遗传算法优化BP神经网络的钢带厚度预测 |

【精选】【bp预测】基于模拟退火遗传算法优化BP神经网络的钢带厚度预测

|

一、模拟退火算法

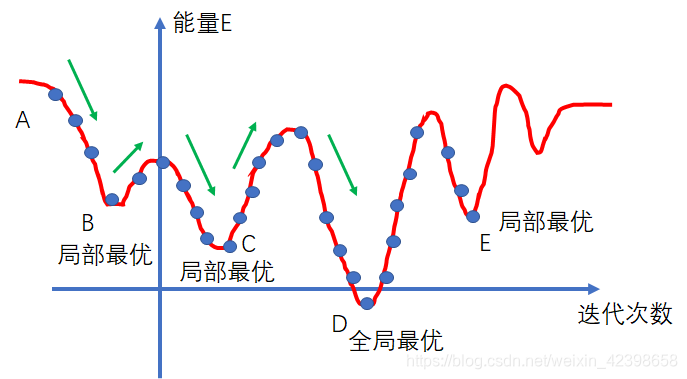

模拟退火算法: 为了解决局部最优解问题, 1983年,Kirkpatrick等提出了模拟退火算法(SA)能有效的解决局部最优解问题。我们知道在分子和原子的世界中,能量越大,意味着分子和原子越不稳定,当能量越低时,原子越稳定。‘退火’是物理学术语,指对物体加温在冷却的过程。模拟退火算法来源于晶体冷却的过程,如果固体不处于最低能量状态,给固体加热再冷却,随着温度缓慢下降,固体中的原子按照一定形状排列,形成高密度、低能量的有规则晶体,对应于算法中的全局最优解。而如果温度下降过快,可能导致原子缺少足够的时间排列成晶体的结构,结果产生了具有较高能量的非晶体,这就是局部最优解。因此就可以根据退火的过程,给其在增加一点能量,然后在冷却,如果增加能量,跳出了局部最优解,这本次退火就是成功的,下面我们就详细讲讲他是如何在局部最优解跳出来到全局最优解的: 模拟退火算法包含两个部分即Metropolis算法和退火过程。Metropolis算法就是如何在局部最优解的情况下让其跳出来,是退火的基础。1953年Metropolis提出重要性采样方法,即以概率来接受新状态,而不是使用完全确定的规则,称为Metropolis准则,计算量较低。下面先形象的说一下,然后在因此数学公式:

假设开始状态在A,随着迭代次数更新到B的局部最优解,这时发现更新到B时,能力比A要低,则说明接近最优解了,因此百分百转移,状态到达B后,发现下一步能量上升了,如果是梯度下降则是不允许继续向前的,而这里会以一定的概率跳出这个坑,这各概率和当前的状态、能量等都有关系,下面会详细说,如果B最终跳出来了到达C,又会继续以一定的概率跳出来,可能有人会迷惑会不会跳回之前的B呢?下面会解释,直到到达D后,就会稳定下来。所以说这个概率的设计是很重要的,下面从数学方面进行解释。 假设前一个状态为 从上式我们可以看到,如果能量减小了,那么这种转移就被接受(概率为1),如果能量增大了,就说明系统偏离全局最优值位置更远了,此时算法不会立刻将其抛弃,而是进行概率操作:首先在区间【0,1】产生一个均匀分布的随机数 退火算法的参数控制 Metropolis算法是模拟退火算法的基础,但是直接使用Metropolis算法 可能会导致寻优速度太慢,以至于无法实际使用,为了确保在有限的时间收敛,必须设定控制算法收敛的参数,在上面的公式中,可以调节的参数就是T,T如果过大,就会导致退火太快,达到局部最优值就会结束迭代,如果取值较小,则计算时间会增加,实际应用中采用退火温度表,在退火初期采用较大的T值,随着退火的进行,逐步降低,具体如下: (1)初始的温度T(0)应选的足够高,使的所有转移状态都被接受。初始温度越高,获得高质量的解的概率越大,耗费的时间越长。 (2) 退火速率。 最简单的下降方式是指数式下降: 其中 (3)终止温度 如果在若干次迭代的情况下每有可以更新的新状态或者达到用户设定的阈值,则退火完成。 模拟退火的步骤: 1.模拟退火算法可以分解为解空间、目标函数和初始解三部分。 2.模拟退火的基本思想: (1) 初始化:初始温度T(充分大),初始解状态S(是算法迭代的起点),每个T值的迭代次数L (2) 对k=1, …, L做第(3)至第6步: (3) 产生新解S′ (4) 计算增量ΔT=C(S′)-C(S),其中C(S)为代价函数 (5) 若ΔT0,然后转第2步。 模拟退火算法新解的产生和接受可分为如下四个步骤: 第一步是由一个产生函数从当前解产生一个位于解空间的新解;为便于后续的计算和接受,减少算法耗时,通常选择由当前新解经过简单地变换即可产生新解的方法,如对构成新解的全部或部分元素进行置换、互换等,注意到产生新解的变换方法决定了当前新解的邻域结构,因而对冷却进度表的选取有一定的影响。 第二步是计算与新解所对应的目标函数差。因为目标函数差仅由变换部分产生,所以目标函数差的计算最好按增量计算。事实表明,对大多数应用而言,这是计算目标函数差的最快方法。 第三步是判断新解是否被接受,判断的依据是一个接受准则,最常用的接受准则是Metropolis准则: 若ΔTnewbestfitness

bestfitness=newbestfitness;

bestchrom=individuals.chrom(newbestindex,:);

end

individuals.chrom(worestindex,:)=bestchrom;

individuals.fitness(worestindex)=bestfitness;

avgfitness=sum(individuals.fitness)/sizepop;

trace=[trace;avgfitness bestfitness]; %记录每一代进化中最好的适应度和平均适应度

end

%% 画出适应度曲线

figure

plot(trace(:,1),'b--');

hold on

plot(trace(:,2),'r-.');

title(['适应度曲线 ' '终止代数=' num2str(maxgen)]);

xlabel('进化代数');ylabel('适应度');

legend('平均适应度','最佳适应度')

axis tight

disp('适应度 变量');

x=Decode(lenchrom,bound,bestchrom,fcode);

% 窗口显示

disp([bestfitness x]);

% 把最优初始阀值权值赋予网络预测

%用ABC优化的BP网络进行值预测

w1=x(1:inputnum*hiddennum);

B1=x(inputnum*hiddennum+1:inputnum*hiddennum+hiddennum);

w2=x(inputnum*hiddennum+hiddennum+1:inputnum*hiddennum+hiddennum+hiddennum*outputnum);

B2=x(inputnum*hiddennum+hiddennum+hiddennum*outputnum+1:inputnum*hiddennum+hiddennum+hiddennum*outputnum+outputnum);

net.iw{1,1}=reshape(w1,hiddennum,inputnum);

net.lw{2,1}=reshape(w2,outputnum,hiddennum);

net.b{1}=reshape(B1,hiddennum,1);

net.b{2}=B2;

% BP网络训练

% 网络进化参数

net.trainParam.epochs=100;

net.trainParam.lr=0.1;

net.trainParam.mc = 0.8;%动量系数,[0 1]之间

net.trainParam.goal=0.001;

% 网络训练

net=train(net,inputn,outputn);

% BP训练集预测

BP_sim=sim(net,inputn);

% 网络输出反归一化

ABC_sim=mapminmax('reverse',BP_sim,outputps);

% 绘图

figure

plot(1:length(output_train),output_train,'b--','linewidth',1)

hold on

plot(1:length(ABC_sim),ABC_sim,'r-.','linewidth',1)

xlabel('训练样本','FontSize',12);

ylabel('钢带厚度(mm)')

legend('实际值','预测值');

axis tight

title('GASA-BP神经网络')

% BP测试集

% 测试数据归一化

inputn_test=mapminmax('apply',input_test,inputps);

%预测输出

an=sim(net,inputn_test);

ABCBPsim=mapminmax('reverse',an,outputps);

figure

plot(1:length(output_test), output_test,'b--','linewidth',1)

hold on

plot(1:length(ABCBPsim),ABCBPsim,'r-.','linewidth',1)

xlabel('测试样本','FontSize',12);

ylabel('钢带厚度(mm)')

legend('实际值','预测值');

axis tight

title('GASA-BP神经网络')

%% 未优化的BP神经网络

net1=newff(inputn,outputn,hiddennum);

% 网络进化参数

net1.trainParam.epochs=100;

net1.trainParam.lr=0.1;

net1.trainParam.mc = 0.8;%动量系数,[0 1]之间

net1.trainParam.goal=0.001;

% 网络训练

net1=train(net1,inputn,outputn);

% BP训练集预测

BP_sim1=sim(net1,inputn);

% 网络输出反归一化

T_sim1=mapminmax('reverse',BP_sim1,outputps);

%预测输出

an1=sim(net1,inputn_test);

Tsim1=mapminmax('reverse',an1,outputps);

% 绘图

figure

plot(1:length(output_train),output_train,'b--','linewidth',1)

hold on

plot(1:length(T_sim1),T_sim1,'r-.','linewidth',1)

xlabel('训练样本','FontSize',12);

ylabel('钢带厚度(mm)')

legend('实际值','预测值');

axis tight

title('BP神经网络')

figure

plot(1:length(output_test), output_test,'b--','linewidth',1)

hold on

plot(1:length(Tsim1),Tsim1,'r-.','linewidth',1)

xlabel('测试样本','FontSize',12);

ylabel('钢带厚度(mm)')

legend('实际值','预测值');

axis tight

title('BP神经网络')

%% GASA-BP和BP对比图

figure

plot(1:length(output_train),output_train,'b--','linewidth',1)

hold on

plot(1:length(ABC_sim),ABC_sim,'r-.','linewidth',1)

hold on

plot(1:length(T_sim1),T_sim1,'g.-','linewidth',1)

xlabel('训练样本','FontSize',12);

ylabel('钢带厚度(mm)')

legend('实际值','GASA-BP预测值','BP预测值');

axis tight

figure

plot(1:length(output_test), output_test,'b--','linewidth',1)

hold on

plot(1:length(ABCBPsim),ABCBPsim,'r-.','linewidth',1)

hold on

plot(1:length(Tsim1),Tsim1,'g.-','linewidth',1)

xlabel('测试样本','FontSize',12);

ylabel('钢带厚度(mm)')

legend('实际值','GASA-BP预测值','BP预测值');

axis tight

%% 结果评价

Result1=CalcPerf(output_test,ABCBPsim);

MSE1=Result1.MSE;

RMSE1=Result1.RMSE;

MAPE1=Result1.Mape;

disp(['GASABP-RMSE = ', num2str(RMSE1)])

disp(['GASABP-MSE = ', num2str(MSE1)])

disp(['GASABP-MAPE = ', num2str(MAPE1)])

Result2=CalcPerf(output_test,Tsim1);

MSE2=Result2.MSE;

RMSE2=Result2.RMSE;

MAPE2=Result2.Mape;

disp(['BP-RMSE = ', num2str(RMSE2)])

disp(['BP-MSE = ', num2str(MSE2)])

disp(['BP-MAPE = ', num2str(MAPE2)])

四、仿真结果

[1]邵文馨,缑林峰,曾宪艺,申雅雯. 快速模拟退火算法优化BP模糊神经网络航空发动机控制[A]. 中国航天第三专业信息网、中国科协航空发动机产学联合体(筹).中国航天第三专业信息网第四十届技术交流会暨第四届空天动力联合会议论文集——S11发动机控制及相关技术[C].中国航天第三专业信息网、中国科协航空发动机产学联合体(筹):中国航天第三专业信息网,2019:8.

|

【本文地址】