| 【ML】线性回归和逻辑回归的联系和区别 | 您所在的位置:网站首页 › 逻辑回归适用于什么场景 › 【ML】线性回归和逻辑回归的联系和区别 |

【ML】线性回归和逻辑回归的联系和区别

|

一、线性回归和逻辑回归

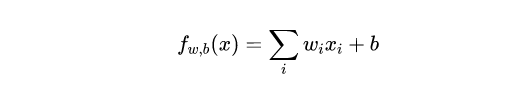

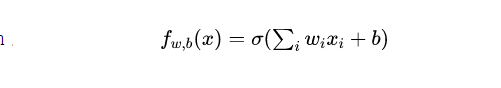

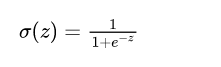

线性回归解决的是回归问题,逻辑回归相当于是线性回归的基础上,来解决分类问题。 线性回归(Linear Regression): sigmoid函数就是:

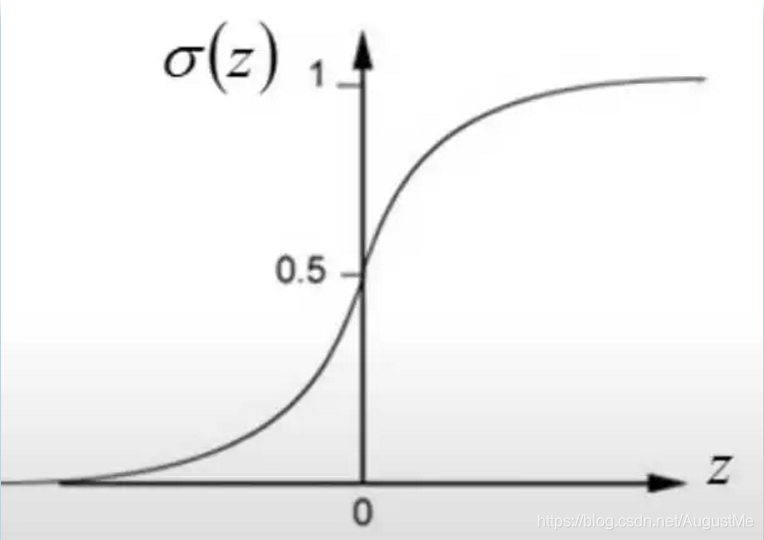

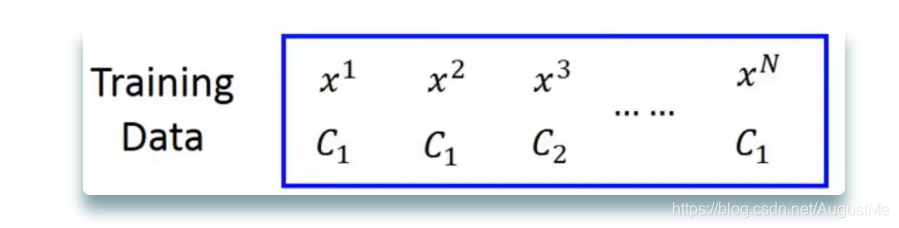

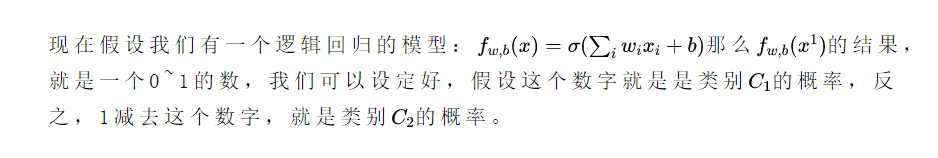

联系: 逻辑回归可以理解为在线性回归后加了一个sigmoid函数。将线性回归变成一个0~1输出的分类问题。 区别: 1.线性回归用来预测连续的变量(房价预测),逻辑回归用来预测离散的变量(分类,癌症预测) 2. 线性回归是拟合函数,逻辑回归是预测函数 3. 线性回归的参数计算方法是最小二乘法,逻辑回归的参数计算方法是似然估计的方法 附加1: 1)线性回归要求变量服从正态分布,逻辑回归对变量分布没有要求。 2)线性回归要求因变量是连续性数值变量,逻辑回归要求因变量是分类型变量。 3)线性回归要求自变量和因变量呈线性关系,逻辑回归不要求自变量和因变量呈线性关系 4)逻辑回归是分析因变量取某个值的概率与自变量的关系,而线性回归是直接分析因变量与自变量的关系 总之,逻辑回归与线性回归实际上有很多相同之处,最大的区别就在于他们的因变量不同,其他的基本都差不多,正是因为如此,这两种回归可以归于同一个家族,即广义线性模型(generalized linear model)。这一家族中的模型形式基本上都差不多,不同的就是因变量不同,如果是连续的,就是多重线性回归,如果是二项分布,就是逻辑回归。逻辑回归的因变量可以是二分类的,也可以是多分类的,但是二分类的更为常用,也更加容易解释。所以实际中最为常用的就是二分类的逻辑回归。 附加2:似然估计逻辑回归参数 举个例子,现在我们有了一个训练数据集,是一个二分类问题:

https://mp.weixin.qq.com/s/cxHzq6Go6yjXO-wC8xpgOg https://mp.weixin.qq.com/s/HiO8TyY5VpOYwFnCRzyZCw https://mp.weixin.qq.com/s/Decb3uTKpqSWe6SY6qfKiw |

【本文地址】

逻辑回归:

逻辑回归:  从上面两个公式:逻辑回归可以理解为在线性回归后加了一个sigmoid函数。将线性回归变成一个0~1输出的分类问题。

从上面两个公式:逻辑回归可以理解为在线性回归后加了一个sigmoid函数。将线性回归变成一个0~1输出的分类问题。 函数图像是:

函数图像是: 线性回归得到大于0的输出,逻辑回归就会得到0.5 ~ 1的输出;线性回归得到小于0的输出,逻辑回归就会得到0 ~ 0.5的输出;

线性回归得到大于0的输出,逻辑回归就会得到0.5 ~ 1的输出;线性回归得到小于0的输出,逻辑回归就会得到0 ~ 0.5的输出; 上面的

x

1

x^1

x1是样本,下面的

C

C

C1是类别,总共有两个类别。

上面的

x

1

x^1

x1是样本,下面的

C

C

C1是类别,总共有两个类别。  似然简单的理解,就是让我们上面的数据集出现的概率最大我们来理解一下:

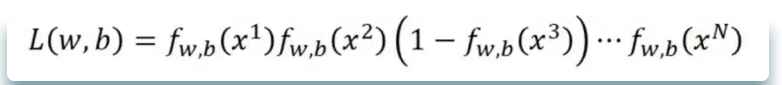

似然简单的理解,就是让我们上面的数据集出现的概率最大我们来理解一下: 样本之间彼此独立,那么上面那个数据集的概率是什么? 是每一个样本的乘积,这个就是似然Likelihood:

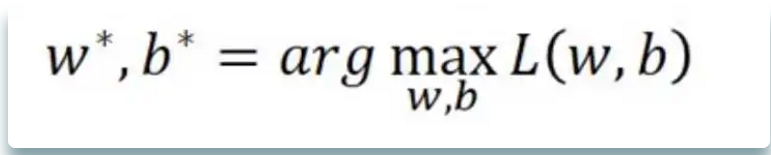

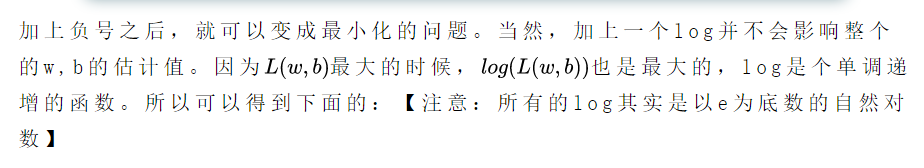

样本之间彼此独立,那么上面那个数据集的概率是什么? 是每一个样本的乘积,这个就是似然Likelihood:  我们希望这个w,b的参数估计值,就是能获得最大化似然的那个参数。也就是:

我们希望这个w,b的参数估计值,就是能获得最大化似然的那个参数。也就是:

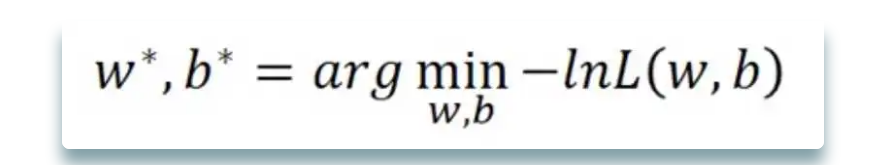

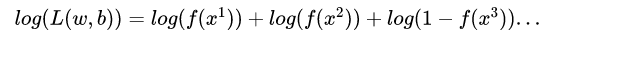

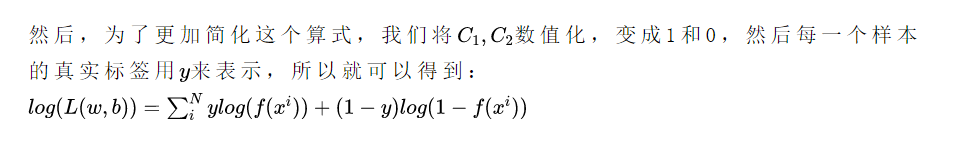

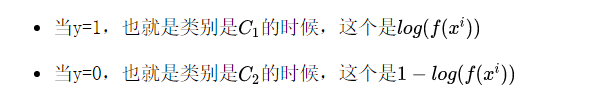

log又可以把之前的乘积和,转换成加法:

log又可以把之前的乘积和,转换成加法:

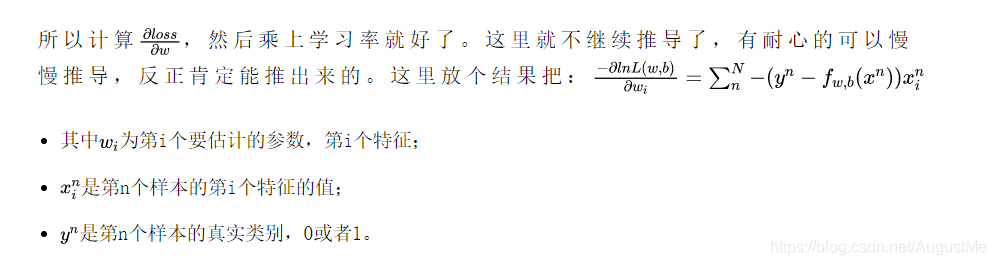

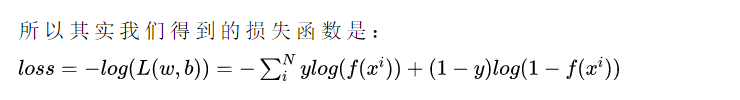

要找到让这个loss最小的时候的w和b,那怎么找?【梯度下降】

要找到让这个loss最小的时候的w和b,那怎么找?【梯度下降】