| 机器学习考试常用简答和论述总结 | 您所在的位置:网站首页 › 答题模型 › 机器学习考试常用简答和论述总结 |

机器学习考试常用简答和论述总结

|

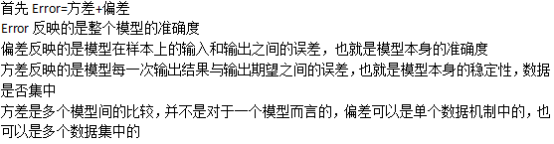

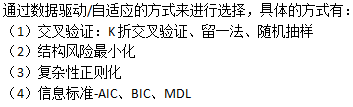

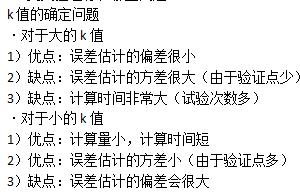

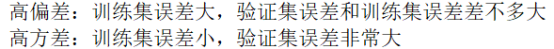

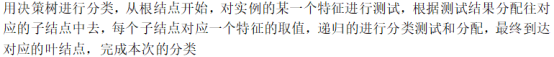

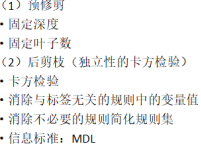

机器学习考试总结,简答题 1.监督学习和非监督学习是什么 监督学习,是其训练集的数据是提前分好类,带有标签的数据,进行学习到模型以及参数,当用测试集进行测试时,给出D测={Xi}=>{yi} 非监督学习,需要将一系列没有标签的训练数据,输入到算法中,需要根据样本之间的相似性对样本集进行分类或者分析。 2.什么是机器学习,解决问题的思路是什么,关键步骤是哪一步 机器学习是一门专门研究计算机怎样模拟或实现人类的学习行为,以获取新的知识或技能,重新组织已有的知识结构使之不断改善自身性能的学科。 过程或者思路: 获取数据,数据预处理,特征提取,特征选择,推理预测识别 其中数据预处理,特征提取,特征选择部分称为特征表达,是关键性步骤 3.学习过程中的过拟合和欠拟合是什么,产生的原因 偏差是描述模型的期望预测与真实结果之间的偏离程度 偏差大说明模型拟合能力差,此时欠拟合 方差是描述数据扰动造成的模型性能的变化,即模型在不同数据集上的稳定程度 方差大,说明模型稳定性差,训练集上拟合优秀,测试集上拟合差,则方差大,此时过拟合 欠拟合,模型参数学习的过少,模型不能很好地拟合数据 过拟合:把一些不必要的特征过度计算了 4.机器学习中怎么划分数据集的,评估方法有哪几种,分别解释 评估方法就是如何划分数据集,应该要求测试集与训练集之间互斥,用测试集来预测评估模型 方法: 留出法:就是将整个数据集 按照某种比例进行划分成训练集和测试集,要注意分层对数据采样,多次重复划分,测试集最好保持在20-30%的数据量上 交叉验证法:将全部数据集 S分成 k个不相交的子集,每次从分好的子集中里面,拿出一个作为测试集,其它k-1个作为训练集,根据训练集训练出模型,放到测试集上,得出结果。 计算k次求得的结果的平均值,作为该模型的真实结果。 留一法:是交叉验证法的一种,每次只留下一个样本做测试集,其它样本做训练集,如果有k个样本,则需要训练k次,测试k次。适合小样本数据。 自助法:基于自助采样、亦称“有放回采样”、“可重复采样”,训练集与原样本集同规模 数据分布有所改变 5.什么是最大似然学习 已知某个参数的值在这个样本中出现的概率最大,把这个参数作为估计的真实值。 最大似然估计是已经知道了结果,然后寻找使该结果出现可能性最大的条件,以此作为估计值。 6.求解最大似然估计值的一般步骤 1.写出似然函数,2.对似然函数取对数,并整理3.求导,令导数为零,得到似然方程4,解似然方程,得到的参数即为所求。 7.什么是最大后验概率 在给定观测数据和先验信念的情况下,选择最有可能的值(结合自己理解) 8.朴素贝叶斯分类器的优缺点 若条件独立性假设成立,则朴素贝叶斯分类器是最佳分类器 朴素贝叶斯模型发源于古典数学理论,有稳定的分类效率 对缺失数据不敏感,算法简单,常用于文本分类,分类准确度高,速度快 但需要先知道先验概率,因此在某些时候由于假设的先验模型的原因导致预测的效果不佳 9.分类器分为哪几种模型,分别介绍 分成判别式模型和生成式模型。 生成式模型:由数据学习联合概率分布P(X,Y),然后由P(Y|X)=P(X,Y)/P(X),求出概率分布P(Y|X)作为预测的模型,该方法表示了给定输入X与输出Y之间的生成关系 判别式模型:由数据直接学习决策函数y=f(x)或者条件概率分布P(Y|X)作为预测模型,判别方法关心的是对于给定输入X应预测出什么样的输出Y 判别式模型方便很多,因为生成式模型要学习一个X,Y的联合分布往往需要很多数据,而判别式模型需要的数据则相对少,因为判别式模型更关注输入特征的差异性。不过生成式既然使用了更多数据来生成联合分布,自然也能够提供更多的信息 若给定无限数据,条件独立性假设成立,判别式和生成式表现相似 若不成立,则判别式优于生成式 判别式:逻辑回归,线性回归,SVM,决策树,神经网络 生成式:朴素贝叶斯,贝叶斯网、高斯混合模型 10.什么是回归,回归模型是指什么,什么是线性回归 回归用于预测输入变量和输出变量之间的关系,特别是当输入变量的值发生变化时,输出变量的值随之发生的变化。 回归模型正是表示从输入变量到输出变量之间映射的函数 线性回归的定义是:目标值预期是输入变量的线性组合 就是选择一条线性函数来很好的拟合已知数据并预测未知数据。 11.简述线性回归与逻辑回归之间的联系与差别 线性回归假设响应变量服从正态分布,逻辑回归假设响应变量服从伯努利分布 线性回归优化的目标函数是均方误差(最小二乘法),而逻辑回归优化的是似然函数(交叉熵) 线性回归要求自变量与因变量呈线性关系,而逻辑回归研究的是因变量取值的概率与自变量的概率 逻辑回归处理的是分类问题,线性回归处理的是回归问题,这也导致了两个模型的取值范围不同:0-1和实数域 联系: 两个都是线性模型,线性回归是普通线性模型,逻辑回归是广义线性模型 表达形式上,逻辑回归是线性回归套上了一个Sigmoid函数 12.机器学习中的参数方法和非参数方法是什么,其方法都有哪些 参数化方法:在训练期间从我们的输入数据中学习模型,它的优点是可以用少量的参数来定义,这些参数可以很容易地用来表示模型,而不用考虑训练集的大小。 对于一些函数形式(高斯,伯努利,多项式,logistic,线性)对于估计参数 非参数方法:密度估算、分类、回归。对于这些,通常不做任何分配假设,因为我们有更多的数据,我们应该能够学习更复杂的模型,让参数的数量与训练数据的数量成比例 13.多层神经网络一般由哪些层组成,每层(节点)什么含义 在神经网络中,处理单元通常按层次分布于神经网络的输入层、隐层和输出层 输入层:接受与处理训练数据集中的各输入变量值 隐层:实现非线性数据的线性变换 输出层:给出输出变量的分类或预测结果 14.L2正则化是什么,L1正则化 21.如何选择一个正确的复杂度模型 22.交叉验证存在哪些问题 23.如何判断自己 24.决策树的决策过程 25.决策树的优缺点 26.如何简单化决策树 27.机器学习的性能指标靠什么来度量,损失函数有哪些,风险函数有哪些,称为什么,哪些算法用这些函数 |

【本文地址】

使用最大似然估计MLE,和最大后验概率MAP,提前需要很少的数据点来学习参数。

使用最大似然估计MLE,和最大后验概率MAP,提前需要很少的数据点来学习参数。 15.反向传播算法是什么,过程描述

15.反向传播算法是什么,过程描述

16.传统BP算法的不足之处在哪 梯度越来越稀疏,从顶层越往下,误差校正信号越来越小,梯度扩散 收敛到局部最优,尤其是从远离最优区域开始的时候 通常,算法只能用于有标签的数据训练,但大部分数据是没有标签的 17.集成学习的思想、方法 即便某一个弱分类器得到了错误的预测,其他的弱分类器也可以将错误纠正回来。 集成方法是将几种机器学习技术组合成一个预测模型的元算法,以达到减小方差、偏差或改进预测的效果。 18.在组合分类器中,bagging与Boosting方法的比较

16.传统BP算法的不足之处在哪 梯度越来越稀疏,从顶层越往下,误差校正信号越来越小,梯度扩散 收敛到局部最优,尤其是从远离最优区域开始的时候 通常,算法只能用于有标签的数据训练,但大部分数据是没有标签的 17.集成学习的思想、方法 即便某一个弱分类器得到了错误的预测,其他的弱分类器也可以将错误纠正回来。 集成方法是将几种机器学习技术组合成一个预测模型的元算法,以达到减小方差、偏差或改进预测的效果。 18.在组合分类器中,bagging与Boosting方法的比较  19.支持向量机是什么,与感知机的区别与联系 支持向量机是一种二分类监督学习模型,定义在特征空间上间隔最大的线性模型 感知机,只需要找到可以将数据正确划分的超平面即可,而SVM需要找到间隔最大的超平面将数据划分开,感知机超平面无数个,而SVM只有一个 20.偏差和方差的区别

19.支持向量机是什么,与感知机的区别与联系 支持向量机是一种二分类监督学习模型,定义在特征空间上间隔最大的线性模型 感知机,只需要找到可以将数据正确划分的超平面即可,而SVM需要找到间隔最大的超平面将数据划分开,感知机超平面无数个,而SVM只有一个 20.偏差和方差的区别

的模型偏差大还是小

的模型偏差大还是小

论述题(一般公式推导不会考):

论述题(一般公式推导不会考): 28.怎样去度量一个算法学习生成的模型是好是坏,怎样评判

28.怎样去度量一个算法学习生成的模型是好是坏,怎样评判  29.线性回归怎么去进行求解,哪两种办法,分别简述过程及原理,并给出两种方法之间的联系与区别

29.线性回归怎么去进行求解,哪两种办法,分别简述过程及原理,并给出两种方法之间的联系与区别  30.密度估算有哪几种,分别讲述,并列出公式,以及每一个方法的特点,怎么调整算法

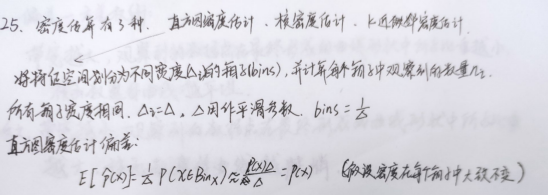

30.密度估算有哪几种,分别讲述,并列出公式,以及每一个方法的特点,怎么调整算法

31.密度估算中KNN和其他两种方法的差别是什么

31.密度估算中KNN和其他两种方法的差别是什么  32.怎么求解超平面方程WT+b=0及其推导,涉及到的目标函数,约束条件,关于拉格朗日函数,对偶问题,求偏导(详细过程推导)

32.怎么求解超平面方程WT+b=0及其推导,涉及到的目标函数,约束条件,关于拉格朗日函数,对偶问题,求偏导(详细过程推导)