| (8) 概率分布 Probability Distribution (a) : 贝叶斯概率,Beta 分布,狄利克雷分布 | 您所在的位置:网站首页 › 狄利克雷分布采样 › (8) 概率分布 Probability Distribution (a) : 贝叶斯概率,Beta 分布,狄利克雷分布 |

(8) 概率分布 Probability Distribution (a) : 贝叶斯概率,Beta 分布,狄利克雷分布

(8) 概率分布 Probability Distribution (a) : 贝叶斯概率,Beta 分布,狄利克雷分布 - PRML && CS229

魔王梦蝶

分类:机器学习

发布时间 2021.12.22阅读数 2196 评论数 0

魔王梦蝶

分类:机器学习

发布时间 2021.12.22阅读数 2196 评论数 0

———— 凯风自南,吹彼棘心。棘心夭夭,母氏劬劳。 概率论 (Probability Theory)不确定性 (uncertainty) 是机器学习中一个重要概念,它一般由测量误差,温度漂移等因素引起,也可以由采样数据的有限性引起,在实际应用中有重要的指导意义。这时候就需要概率论的知识来描述模型方法的不确定性,从而提供了⼀个合理的框架来量化计算,同时需要概率分布来描述数据的分布,概率论也因此成了模式识别的⼀个中⼼基础。本文先介绍一些概率论的重要基础概念引入话题,再接着讲述两种重要的分布。 1. 概率密度 (Probability Density)虽然生活中我们更多使用离散概率描述事件,但是对于机器学习的推导,更多情况下需要分析的对象是连续变量,这时候就需要引出概率密度 (probability density)。如果⼀个实值变量 由于概率是⾮负的,并且 在变量以⾮线性的形式变化的情况下,概率密度函数通过 Jacobian 因⼦变换为不同的函数形式。考虑两个变量 表明 位于区间 概率密度的加和规则和乘积 加和规则的正确性可以⾮形式化地观察出来:把每个实数变量除以区间的宽度 涉及到概率的⼀个重要的操作是寻找函数的加权平均值。在概率分布 如果考虑多变量函数的期望,我们可以使⽤下标来表明被平均的是哪个变量,例如 也可以考虑关于⼀个条件分布的条件期望 (conditional expectation),即

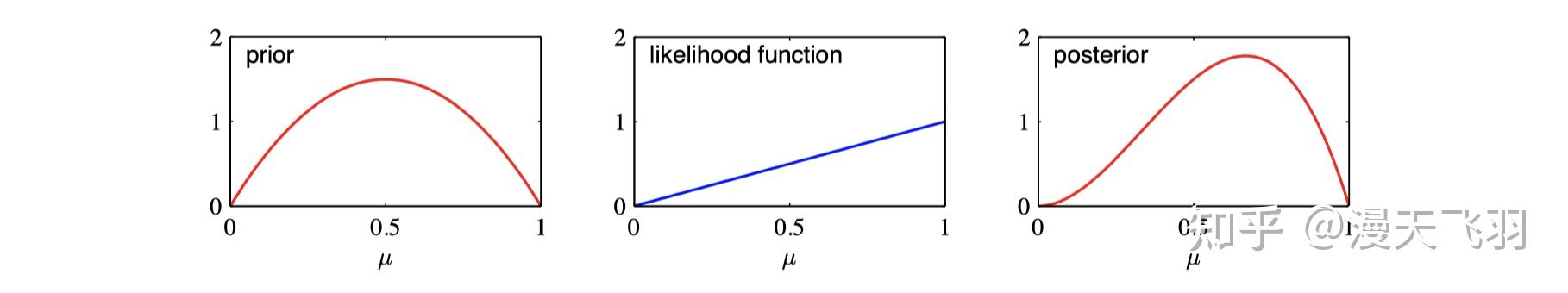

对于两个随机变量 它表示在多⼤程度上 在两个随机向量 在前几篇文章的最大似然估计中,我们对模型参数 它让我们能够通过后验概率 在似然函数 贝叶斯观点的⼀个优点是天然包含先验概率。例如,假定投掷⼀枚普通的硬币 3 次,每次都是正⾯朝上,经典的最⼤似然模型在估计硬币正⾯朝上的概率时结果会是 1,表示所有未来的投掷都会是正⾯朝上。相反,⼀个带有合理的先验的贝叶斯的⽅法将不会得出这么极端的结论。在第一篇文章就讲过,如果使用带贝叶斯估计的模型相当于增加了 然而先验概率的选择是十分麻烦的,一种针对贝叶斯⽅法的⼴泛批评就是先验概率的选择通常是为了计算的⽅便⽽不是为了反映出任何先验的知识。实际上当先验选择不好的时候,贝叶斯⽅法有很⼤的可能性会给出错误的结果。 概率分布 (Probability Distribution)为了描述机器学习模型方法中的不确定性,我们需要研究一些特殊的概率分布。我们讨论的概率分布是在给定有限次观测 我们要研究的都是参数分布 (parametric distribution),表示少量可调节的参数控制了整个概率分布,例如高斯分布的均值和方差。在之前的最大似然方法中,我们在给定观察数据集的条件下,确定最优的参数值。但在贝叶斯观点中,给定观察数据,我们需要先引⼊参数的先验分布,然后使⽤贝叶斯定理来计算对应后验概率分布。 这时候我们需要引入共轭先验 (conjugate prior),它使后验概率分布的函数形式与先验概率相同,从而使贝叶斯分析得到极⼤的简化。例如,伯努利分布参数的共轭先验叫做 Beta 分布,多项式分布参数的共轭先验叫做狄利克雷分布 (Dirichlet distribution),⾼斯分布均值的共轭先验是另⼀个⾼斯分布。关于伯努利分布等不再赘述,本文重点讨论这些共轭先验分布。 1. Beta 分布 (Beta Distribution)首先设定二元随机变量 我们也可以求解给定采样数据大小为 其中 为了⽤贝叶斯的观点看待这个问题,需要引⼊⼀个关于 其中 Gamma 函数 其中均值和方差分别为 再通过归⼀化得到 其中 另外,如果我们接下来观测到更多的数据,那么后验概率分布可以扮演先验概率的角⾊。假想每次取⼀个观测值,然后在每次观测之后更新当前的后验分布。在每个阶段,上一次观测后的后验概率作为先验概率,与似然函数相乘再进行归一化得到新的后验概率。后验概率是⼀个 Beta 分布,对于  图片来自 Bishop PRML. Figure 2.3.

图片来自 Bishop PRML. Figure 2.3.

如果接受了贝叶斯观点,那么学习过程中的顺序⽅法可以⾃然得出,它与先验和似然函数的选择⽆关,只取决于数据独⽴同分布的假设。顺序⽅法每次使⽤⼀个或⼀⼩批观测值,然后在使⽤下⼀个观测值之前丢掉它们。在实时学习场景中,输⼊为⼀个稳定持续的数据流,模型必须在观测到所有数据之前就进⾏预测,同时也不需要把所有的数据都存储到内存⾥,在很多机器学习和深度学习模型中都广泛使用,例如小批量梯度下降算法。 在上面的例子中,如果我们想尽可能好地预测下⼀次的输出,那应该估计给定观测数据集 使用公式 (17) 并代入 Beta 分布的均值,可得 这个结果可简单表述为 观察 Beta 分布的方差也会发现,如果 这表明 左侧项是 二项分布是描述只有两种取值的变量的概率分布,实际中我们更多遇到多种可能取值的离散变量,我们采用 one-hot 编码方式,输入向量 其中 以及期望形式 现在考虑⼀个有 可以看到似然函数对于 为了找到 令其关于 现在考虑 称为多项式分布 (multinomial distribution)。归⼀化系数是把 同样地,对应于多项式分布的参数 关于 这被称为狄利克雷分布 (Dirichlet distribution),其中 我们看到后验分布的形式又变成了狄利克雷分布,这说明,狄利克雷分布确实是多项式分布的共轭先验。通过确定归一化系数,可得 其中, 下一篇将讨论高斯分布。 建模仿真机器学习概率论概率分布贝叶斯概率

打赏 0 点赞 0 收藏 0 分享 微信 微博 QQ 图片 上一篇:(7) 信息论 Information Theory : 信息熵,熵的物理意义,相对熵,互信息 - PRML && CS229 下一篇:(9) 概率分布 Probability Distribution (b) : 高斯分布,混合高斯模型 - PRML && CS229 |

【本文地址】