| 基于BiLSTM | 您所在的位置:网站首页 › 基于条件随机场CRFs的中文词性标注方法 › 基于BiLSTM |

基于BiLSTM

|

基于BiLSTM-CRF模型的分词、词性标注、信息抽取任务的详解,侧重模型推导细化以及LAC分词实践

1.GRU简介

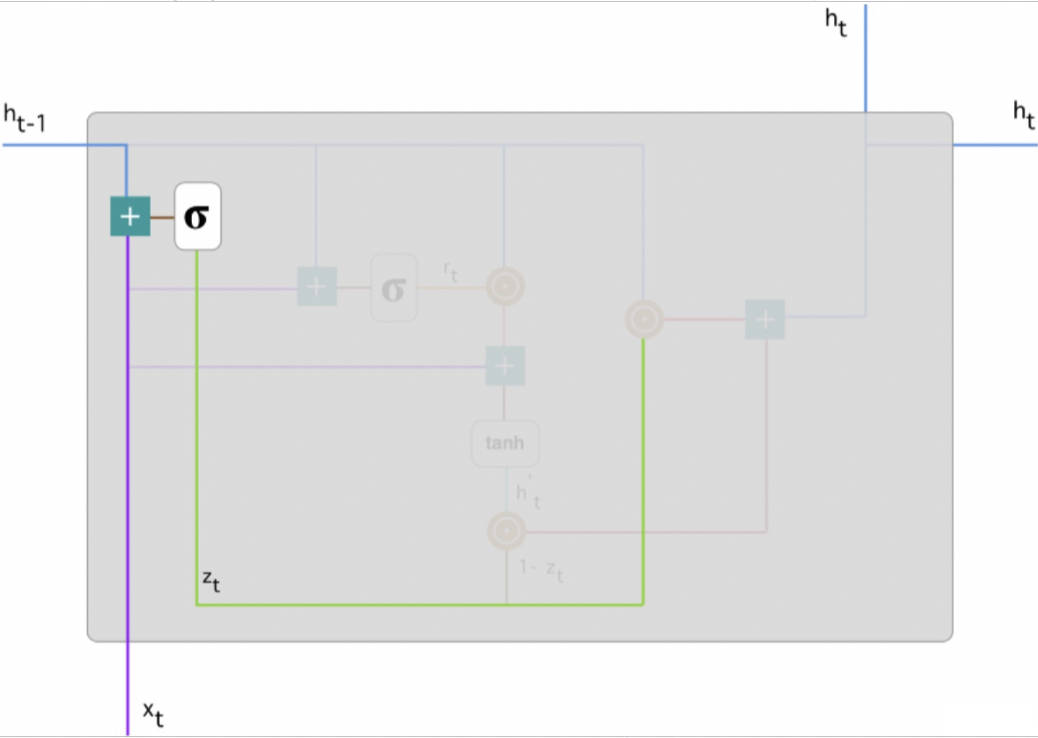

GRU(Gate Recurrent Unit)门控循环单元,是[循环神经网络](RNN)的变种种,与 LSTM 类似通过门控单元解决 RNN 中不能长期记忆和反向传播中的梯度等问题。与 LSTM 相比,GRU 内部的网络架构较为简单。 GRU 内部结构RU 网络内部包含两个门使用了更新门(update gate)与重置门(reset gate)。重置门决定了如何将新的输入信息与前面的记忆相结合,更新门定义了前面记忆保存到当前时间步的量。如果我们将重置门设置为 1,更新门设置为 0,那么我们将再次获得标准 [RNN]模型。这两个门控向量决定了哪些信息最终能作为门控循环单元的输出。这两个门控机制的特殊之处在于,它们能够保存长期序列中的信息,且不会随时间而清除或因为与预测不相关而移除。 GRU 门控结构如下图所示:

更新门帮助模型决定到底要将多少过去的信息传递到未来,或到底前一时间步和当前时间步的信息有多少是需要继续传递的。

其中 Xt 为第 t 个时间步的输入向量,即输入序列 X 的第 t 个分量 |

【本文地址】

公司简介

联系我们