| 【翻译】Stable Diffusion prompt: a definitive guide | 您所在的位置:网站首页 › 何为sampler › 【翻译】Stable Diffusion prompt: a definitive guide |

【翻译】Stable Diffusion prompt: a definitive guide

|

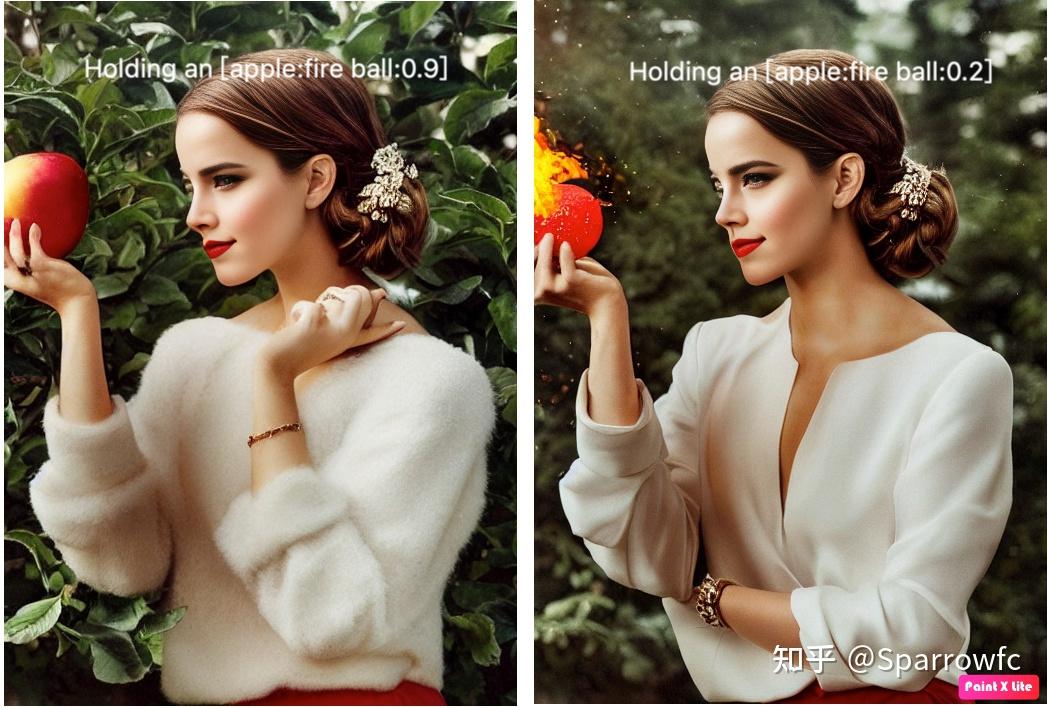

搬运正文前简单说两句: AI绘图22年刚出的时候就关注并且试玩了一下,很快就弃掉了,无他,卖家秀与买家秀差别太大了,看着自己生成的一张张垃圾图去比对其他人生成的精美作画实在是劝退。直到最近出来ControlNet刷了一波屏,感觉离可用的生产工具又进了一步,这才又重新研究了起来。结果发现仅仅几个月,整个AI绘画的进步速度让我着实感觉到了后脊发凉。大家现在发了疯的用AI搞图,玩儿新的工具(Controlnet)、插件(LORA, Dreambooth, Hypernetwork)和模型(ChilloutMix dddd),但是在B站和知乎上却都没有看到比较系统的关于Stable Diffusion的使用介绍,让我一时有些不知道从何入手。 这篇新手教学文章援引自 https://stable-diffusion-art.com/tutorials/ 这个网站,强烈建议刚入门的新手把这个网站下的每篇文章都读一遍,可以说涵盖了Stable Diffusion最前沿使用的方方面面,能让你以最快的速度,来对最新的各个模型、插件的原理、技术及使用方式都有所了解。 Prompt是AI绘图中最重要的输入控制项,即是现在已经有了非常多的定制化模型能够让你更直接简单的生成某一特定风格的图像,你仍然需要会写一个好的Prompt才能够得到一张值得展示的图像。相信大部分中文用户和我一样大概都是英文阅读3星+,写作0星的选手,看别人改别人的Prompt还行,纯自己写的话脑中除了very very beautiful ☝️ 以外就蹦不出别的啥词儿来了。而这篇基础教学文章通过对关键词分类的方式,让你可以更加明确的知道应该使用或查询哪些词汇来构建你所需要的图像,另外文章还介绍了关键词权重及混合等非常实用的技巧,以及SD是如何理解你的输入词汇等基础知识,相信无论你是想要修改Prompt还是从零自己写Prompt,无论是新手还是老手,即使已经开始使用chatGPT来辅助生成prompt了,这篇文章都仍然非常值得一看。 本文原文链接为 https://stable-diffusion-art.com/prompt-guide/ 以下是正文翻译,请勿转载: Stable Diffusion prompt: a definitive guide了解如何构建出优秀的提示指令(prompt)的方法,是每个SD用户首先要学习的事情。本文通过总结实验与前人的经验,给出构建指令的方法与相关技巧。总之,在这篇文章里,你将了解到有关prompt的所有信息。 何为优秀的提示指令一个优秀的提示指令应该是详尽而具体的。一个好的方法是在关键词(keywords)分组列表中找到一个与你的需求所匹配的词汇。 关键词的分组如下: 1. 主体(Subject) 2. 绘画介质 (Medium) 3. 绘画风格(Style) 4. 艺术家名(Artist) 5. 网站(Website) 6. 清晰度(Resolution) 7. 细节描述(Additional details) 8. 颜色(Color) 9. 光线(Lighting) 在实际编写的一组提示指令中,并不需要包含以上所有的分组里的关键词。你只需要把这个分组列表当作一个提示清单,在添加新的提示词时知道要如何选用即可。 接下来我们将逐一来测试这些分组中的关键词,下面的测试中将使用的是默认模型sd v1.5 base model。 为了能够明确各个关键词的作用,测试中将不使用否定提示指令(negative prompts)。不过别着急,在文章的后面我们还是会学习如何使用否定提示指令的。以下所有的图片都以30 steps , DPM++ 2M Karas sampler以及512x704分辨率参数进行生成。【翻译注:后续翻译文章中所使用的图片都不是原文中的图片,而是译者本人在Colab上使用v1-5-pruned-emaonly.ckpt基础模型复刻的,以防作者胡说八道。其中CFG为7,BatchCount=8,Seed使用-1的随机设置,勾选了Restore face,一般生成3次乃至更多次来选出可用的示例图。另外不同于作者,我添加了"cut off, nude"的否定指令用以提升出图率以及规避审核风险】 主体(Subject)主体表示的是你在图片中所看到的实体。在书写指令时,最通常的错误就是缺少足够的实体关键词。 比如我现在想要生成一张魔女释放法术(a sorceress casting magic)的图片。一个SD的新玩家可能会这么写 A sorceress这么写也是OK的,但是留下了太多的想象空间。这个魔女长什么样子?是否能有任何描述她的词汇可以更明确她的样子?她穿的是什么?她释放的是什么魔法?她是站着,跑着还是漂浮在空中?图像的背景是什么? Stable Diffusion不能读取我们的想法,我们必须切实的告诉全部我们所需要的细节内容。 对于人物主体来说,一个常用的技巧是使用明星的名字,因为这些词对输出结果会有很强的效果,也是一个非常好的用来控制输出主体样貌的方法。不过需要注意的是,使用这些人名除了会导致输出结果的面部不易产生变化外,也会导致输出同质化的姿势、风格以及其他物件。关于这一点,在文章的后面的“关联效果”章节会有详细介绍。 作为示例,我们首先让这个魔女看起来像艾玛沃森,Emma Watson也是在SD中使用最广泛的关键词。我们希望这个魔女充满力量而又神秘,并且使用闪电魔法,她的造型是充满细节点缀的。这样看看能否生成一些有意思的图片。 Emma Watson as a powerful mysterious sorceress, casting lightning magic, detailed clothing Emma Watson在模型中实在是太常见又太出效果了。我认为SD用户这么喜欢使用她的名字,是因为她看起来十分的优雅、年轻,同时在目前网络中的大部分图片中形象是一致的。相信我,不是所有女演员都是这样的,尤其是那些活跃在90年代甚至更早期的女演员们。 绘画介质(Medium)介质表示的是制作绘画所用到的材质。举一些例子如:插画(illustration),油画(oil painting),3D渲染(3D rendering)和摄影(photography)等。介质关键词对输出结果也有较强的作用,一个相关词汇的修改会改变整个输出结果的风格。 我们来添加一个相关的关键词 digital painting Emma Watson as a powerful mysterious sorceress, casting lightning magic, detailed clothing, digital painting 输出结果变成了我们想要的风格!图片从照片变成了数字绘画。 绘画风格(Style)风格代表了一种绘画的艺术风格,举例如:印象派(impressionist),超现实主义(surrealist),流行艺术(pop art)等。 我们向指令中添加一些风格类的关键字试试:hyperrealistic(超写实), fantasy(幻想风), surrealist, full body Emma Watson as a powerful mysterious sorceress, casting lightning magic, detailed clothing, digital painting, hyperrealistic, fantasy, surrealist, full body 嗯....不太好说这些词对结果产生了多大影响,可能是因为这些风格类的关键词已经被前面的关键词所隐含。不过看上去保留他们也没有什么问题。 艺术家(Artist)艺术家的名字也是有高影响权重的关键词。通过指定一个艺术家的名字可以让你输出的内容与其具体的艺术风格所匹配。另外通常也会使用多个艺术家的名字,以得到一种混合的艺术风格。下面我们将添加两个艺术家关键词: Stanley Artgerm Lau,一个超级英雄漫画家,以及 Alphonse Mucha,一个19世纪的肖像画家。 Emma Watson as a powerful mysterious sorceress, casting lightning magic, detailed clothing, digital painting, hyperrealistic, fantasy, surrealist, full body, by Stanley Artgerm Lau and Alphonse Mucha 我们可以看到这两种艺术家的绘画风格融合出来的效果非常好。【翻译注:慕夏是非常有名的画家,在我这个非专业人士的认知中他可以算是塔罗牌画风的创始人了,其绘画有很突出的古典、巴洛克、平面风格,另外一位画家不熟。在生成的示例图中可以看到慕夏风格表现的十分显著,这里我在制作示例图的时候把闪电的英文拼错了,所以你可以看到生成图中基本没有闪电了,不过因为慕夏+艾玛实在有点好看,我也就不修改了】 网站名(Website)图片收集网站像 Artstation 和 Deviant Art 里聚集了大量的有明确流派的图片。 添加这类关键词可以使我们的输出结果趋同于网站上的图像艺术风格。 Emma Watson as a powerful mysterious sorceress, casting lightning magic, detailed clothing, digital painting, hyperrealistic, fantasy, surrealist, full body, by Stanley Artgerm Lau and Alphonse Mucha, artstation 看起来变化不大,但是生成的图片确实看起来像你能从Artstation上找到的图。【翻译注:在复刻的过程中我并不确定作者所说的Website是个有效的关键词类别,当我在webui中输入artstation时,token数量从43变成了45,非常怀疑模型把它拆分为art和station两个单词作为输入处理了(原因见文章后面的“指令可以有多长”章节)。另外网站的画风本身就是多元的,我也不太能理解他会对输出结果产生怎样的影响,在后续的示例中我会删除该关键词,以防止其造成不好的影响。至于与上一节相比,闪电又有了,那只是因为我把lightning拼写修改正确了】 清晰度(Resolution)清晰度代表了输出的图像的锐度与细节度。我们尝试添加这两个关键词:highly detailed,sharp focus。 Emma Watson as a powerful mysterious sorceress, casting lightning magic, detailed clothing, digital painting, hyperrealistic, fantasy, Surrealist, full body, by Stanley Artgerm Lau and Alphonse Mucha, artstation, highly detailed, sharp focus 好吧,看上去没有太大的效果,应该是之前的图片已经很锐化且细节化了,但是添加上也并无坏处。 细节描述(Additional details)细节描述是调整图片的调味剂。我们尝试添加 sci-fi(科幻), stunningly beautiful(绝美)与 dystopian (反乌托邦)来对图像进行一些调整。 Emma Watson as a powerful mysterious sorceress, casting lightning magic, detailed clothing, digital painting, hyperrealistic, fantasy, Surrealist, full body, by Stanley Artgerm Lau and Alphonse Mucha, artstation, highly detailed, sharp focus, sci-fi, stunningly beautiful, dystopian 颜色(Color) 颜色(Color)通过添加颜色关键字,你可以控制图像整体的色彩。你所添加的颜色有可能作为图像整体的色调,或某个物体的颜色。 我们尝试使用关键词 iridescent gold来为图像添加一点金色。 Emma Watson as a powerful mysterious sorceress, casting lightning magic, detailed clothing, digital painting, hyperrealistic, fantasy, Surrealist, full body, by Stanley Artgerm Lau and Alphonse Mucha, artstation, highly detailed, sharp focus, sci-fi, stunningly beautiful, dystopian, iridescent gold 金色的效果很不错! 光照(Lighting)所有摄影师都会告诉你,出片的要素之一就是光照。光照关键字对于生成的图片也有着巨大的影响。我们尝试一下在指令中添加cinematic lighting 与 dark Emma Watson as a powerful mysterious sorceress, casting lightning magic, detailed clothing, digital painting, hyperrealistic, fantasy, Surrealist, full body, by Stanley Artgerm Lau and Alphonse Mucha, artstation, highly detailed, sharp focus, sci-fi, stunningly beautiful, dystopian, iridescent gold, cinematic lighting, dark 以上我们完成了整个演示demo的提示指令的构建 总结可能你注意到了,仅仅向基础的目标对象再添加几个关键关键词(keywords)就已经可以生成出不错的图像出来了。对于构建Stable Diffusion的输入指令来说,通常你并不需要添加太多的关键词 否定提示指令 (Negative prompt)否定提示指令 是另一个非常有效的调整图像的输入,通过输入你不想要的内容,而不是想要的,来实现对图像的调整。否定提示指令并非只能排除实体对象,也可以是风格或者其他一些不想要的图像特征(比如:难看(ugly),异型(deformed)) 如果你使用的是SD的二代模型版本的话(注:目前大部分人使用的是1.4/1.5的一代模型版本),否定提示指令是一个必填项,否则你会得到与一代版本相比差的多的图像。对于一代版本来说,否定指令是可选的,不过在实际使用时都会对其进行设置,毕竟否定指令即使没有提升图像的效果,也不会对其造成什么损害。 我将使用一个通用的否定提示指令。有关其原理与更详细的使用方式,你可以在这篇文章中进行深入了解。 ugly, tiling, poorly drawn hands, poorly drawn feet, poorly drawn face, out of frame, extra limbs, disfigured, deformed, body out of frame, bad anatomy, watermark, signature, cut off, low contrast, underexposed, overexposed, bad art, beginner, amateur, distorted face, blurry, draft, grainy 可以看出否定提示指令使得图像中的主体更加凸显,不会显得过于平面化。 构建良好指令的流程迭代构建你应该使用迭代的过程来构建提示指令,就像前面的示例所演示的,随着关键字逐一添加到主体中,我们最终可以生成非常棒的图片。 我总是从只包含主体(Subject)、介质(Medium)、与风格(Style)关键词的简单指令开始进行构建。生成至少4张图片来观察结果。大部分这样的基础指令并不是能100%起效的。你需要对你所使用的基础关键词能获得什么有一些统计学上的感知。 迭代过程中一次最多添加2个关键词,同样生成至少4张图片来观察其效果 使用否定提示指令使用通用否定提示指令永远是个不会出错的开始。 添加关键词到否定提示指令中也是迭代话构建的一部分。这些否定关键词可以是你希望避免在图像中生成的物体、或者身体部位。(由于一代模型并不太善于渲染手部,通过在否定指令中添加“hand”关键词以在图像中将其直接隐藏也是个不错的选择) 提示指令书写技巧你可以调整一个关键词的影响因子,也可以控制在特定的生成步数(sampling step)后切换关键词。 下面所介绍的语法都可以在 AUTOMATIC111 GUI 【翻译注:就是stable-diffusion-webui】中进行使用。你可以在 Colab notebook 上使用这个工具,也可以将其部署到本地的 Windows 或 Mac 电脑上。 关键词权重(这个语法可以在webui中使用) 你可以使用`(关键词: 权重)`这个语法来控制关键词的影响因子。权重是一个数值,小于1代表其重要度较低,大于1代表其重要度更高。 比如,我们可以在下面的指令中对狗这个关键词添加权重 dog, autumn in paris, ornate, beautiful, atmosphere, vibe, mist, smoke, fire, chimney, rain, wet, pristine, puddles, melting, dripping, snow, creek, lush, ice, bridge, forest, roses, flowers, by stanley artgerm lau, greg rutkowski, thomas kindkade, alphonse mucha, loish, norman rockwell. 添加狗的权重导致图像中出现了更多的狗,而反之则减少。并不是对于所有图片权重起到的都是这样的效果,但是绝大多数情况下,你都可以预期权重会产生这样的效果。 这个技巧不仅可以使用在主体关键词上,对所有关键词类别例如风格或光照都可以使用。 ()与[]语法(这个语法可以在webui中使用) ()与[]是与调整关键词权重等价的语法。`(关键词)`会将括弧中的关键词权重增加1.1倍,其等价于`(关键词:1.1)`。`[关键词]`将括弧中的关键词权重调低至0.9倍,其等价于`(关键词:0.9)`。 你可以像代数公式一样使用多个括弧来倍增其权重影响效果 (keyword):1.1((keyword)):1.21(((keyword))):1.33与之相似的,使用多个中括弧的效果如下: [keyword]: 0.9[[keyword]]: 0.81[[[keyword]]]: 0.73关键词混合(这个语法可以在webui中使用) 你可以混合两个关键词,这种用法准确的来说称作指令调度(prompt scheduling)。语法如下: [关键词1:关键词2:影响因子]`影响因子` 控制在采样的哪一步(step)中提示指令中的关键词1会切换到关键词2,它是一个0到1之间的参数 比如使用如下的指令 Oil painting portrait of [Joe Biden:Donald Trump:0.5]将输入的step参数设置为30 这意味着在生成过程的前15步使用的是下面的指令 Oil painting portrait of Joe Biden而在接下来第16到30步的生成过程中指令将变成下面这样 Oil painting portrait of Donald Trump影响因子参数将决定关键词在何时发生变化,在上面的例子中它将在 30 steps x 0.5 = 15 steps后执行。 调整影响因子所产生的效果可以看作是将两位总统的肖像在不同程度上进行混合。  你也许注意到Trump身着白色西服更想是Biden的服饰搭配,这其实非常好的展现了使用关键词混合中很重要的一个规则:关键词1决定了总体的混合效果。越靠前的diffusion生成步骤越对图像整体的混合结果产生影响,而较靠后的生成步骤则只负责逐渐改进细节。 小测试:如果在上面的例子中将Joe Biden与Donald Trump调换顺序,你觉得对于生成的图片会产生什么影响呢? 面部混合关键词混合的常用于借用两个不同的明星来创建出新的面容。举例来说,[Emma Watson: Amber heard: 0.85],40 steps,将会产生一个介于二者之间的面孔:  [Emma Watson: Amber heard: 0.85] oil painting, blur background, elegant [Emma Watson: Amber heard: 0.85] oil painting, blur background, elegant选择两个合适的名字再加上调整参数,就可以获得我们想要的样貌。 破产版prompt-to-prompt使用关键词混合,你可以获得到类似于 prompt-to-prompt 的效果,即通过编辑生成出一对高度相似的图像。下面的两张图像使用了同样的提示指令,除了使用指令调度语法将苹果替换为了火焰,两张图的seed与steps参数设置也是一样的【翻译注:这里使用的示例图片是我自己做的,与原文不一致,提示指令改成了将苹果替换成了火球,主要原因是替换成火焰没有做出太好的效果图来】  [Emma Watson: Amber heard: 0.75] holding an [apple: fire ball:0.9], shining bokeh depth of field background, classic, oil painting, portrait, elegant, upper class, red lips, ear wearing. Steps: 40, Sampler: DPM++ 2M Karras, CFG scale: 6, Seed: 805277495 [Emma Watson: Amber heard: 0.75] holding an [apple: fire ball:0.9], shining bokeh depth of field background, classic, oil painting, portrait, elegant, upper class, red lips, ear wearing. Steps: 40, Sampler: DPM++ 2M Karras, CFG scale: 6, Seed: 805277495混合因子需要精细的调整。它具体是如何工作的?其背后的理论其实就是:输出图像的整体效果是由早期的扩散过程(diffusion process)决定的。当扩散过程开始聚焦于更小的区域时,切换任何的关键词都不会对图像的整体结果产生较大的影响。这使得这种方式可以仅仅改变图像中的一小部分。 指令可以有多长?指令长度取决于你使用的是哪个Stable Diffusion应用,应用中可能会对你指令(prompt)中的关键词(keyword)数量进行限制。在SD一代的基础版本中,指令的限制是75个词元(token) 需要注意的是词元(token)并不等同于单词(word)。SD所使用的 CLIP模型 会自动将提示指令转化为一组词元,即该模型所知晓的单词的数字表示。如果你使用了该模型所不知道的单词或词组,该单词将会被切分为两个或更多的子单词(sub-words)直到他知道每个单词的含义。因此能够被CLIP模型所认知的单词(word)才被称为词元(token),举例来说`dream`是一个词元,`beach`是一个词元,但是`dreambeach`是两个词元,因为CLIP模型并不知道这个单词,所以会将这个单词分解为`dream`与`beach` 。 AUTOMATIC1111(webui)中的指令限制AUTOMATIC1111的stable-diffusion-webui工具中是没有词元数量限制的。如果一个指令包含了超过75个词元,他会新起一个可以再包含75个词元的指令块,这样,新的指令限制就变成了150个词元。这个过程可以持续重复,直到你的电脑耗尽内存.... 每个包含75个词元的指令块都会单独进行处理,处理后的结果再连接起来(the resulting representations are concatenated)而后送入SD模型中的U-Net网络以执行后续生成过程。 在webui中你可以通过观察prompt输出框右上角的小窗口来了解当前指令包含了多少个词元。  stable-diffusion-webui中的token计数器窗口测试关键词 stable-diffusion-webui中的token计数器窗口测试关键词一些你在别人提供的指令中所看到的关键词并不一定是有效的。就像作业一样,大多时候我们简单的拷贝别的的指令却没有仔细思考。 你可以通过仅仅使用单一的一个关键词来检测它的效果,举例来说,sd v1.5模型是否知道美国画家 Henry Asencio呢?我们可以通过指令来测试一下: by henry asencio 很明显是有效的 那再比如知名网络画手WLOP呢? by WLOP 恩,看起来不是很像,也因此你不应该在指令中使用“by wlop”,这只会给输出结果添加干扰。【翻译注:这个结论只是原文作者基于其所使用的sd v1.5标准模型所得出的。上图给出的示例图是我本机制作的,可以明显看出WLOP的厚涂画风。所以具体到特定关键字能否被模型所识别还是要针对具体模型具体测试,定制化模型也会微调输入模块,更甚者像中文SD模型 - 太乙 可以直接识别中文关键词。又比如使用Dreambooth训练的扩展模型可能会将wlop作为触发词,因此在使用时还是以实际测试为准】 使用Josephine Wall也有正面的反馈  你可以使用这个这个技巧来测试多个艺术家混合后的效果。 Henry asencio, Josephine Wall 限制变化 限制变化为了能构建优秀的提示指令,你需要学会以SD的角度进行思考。其核心即是,SD是一个图像采样器,用于生成出我们人类认为真实且好看的像素值。你甚至可以不输入任何提示指令就使用它,而它将会生成一堆毫不相干的图像。从技术层面来说,这叫做无条件且无指引的扩散。 提示指令(Prompt)是一种指引方式,来使扩散过程朝着与指令匹配的采样空间进行。就像本文最开始所说的,一个提示指令需要非常详尽而具体的。这是因为详尽的指令将缩小最终图像的采样空间,我们来看一个示例: castle castle, blue sky background castle, blue sky background wide angle view of castle, blue sky background wide angle view of castle, blue sky background 通过向指令中添加越来越多的关键词,我们逐渐将生成的图像,从任意一个城堡,缩小为有蓝色天空背景的城堡,并最终缩小为一个广角拍摄的蓝天背景的城堡。 你的提示指令越详尽,产出图片的变化就越小。 关联效果属性关联有些属性关键词是有着强烈的相关性的,当你使用了一个,你也会连带着用到其他的一些属性。Stable Diffusion 生成与关键词最为匹配的图像,着又可能会带来一些意想不到的关联效应。 比如说我们想生成一个拥有蓝眼睛的女性图片 a young female with blue eyes, highlights in hair, sitting outside restaurant, wearing a white outfit, side light 如果我们想改为棕色眼睛呢? a young female with brown eyes, highlights in hair, sitting outside restaurant, wearing a white outfit, side light 你可以看到我在指令中并没有添加任何种族的关键词,但是由于【翻译注:用于训练的图像中】拥有蓝眼睛的人主要是欧洲人,所以生成的图像都是白种人。而棕色眼睛在所有人种中都存在,所以你可以在结果中看到更多人种的变化。 刻板印象与偏见是AI模型中的一个重大课题,在本文中我将只关注于技术层面 明星名字的关联效应每个关键词都有一些意料外的关联,特别是对于明星名字来说。一些演员在拍照时喜欢使用特定的动作或穿着特性的服装风格,而这些照片都属于训练数据的一部分。仔细想想就知道,模型训练本质上就是对于关联关系的学习。如果Taylor Swift在训练数据中总是摆出双腿交叉的造型,那么这个模型就会认为双腿交叉也是Taylor Swift  full body taylor swift in future high tech dystopian city, digital painting full body taylor swift in future high tech dystopian city, digital painting当你在提示指令中使用了Taylor Swift,你可能只想使用她的脸,但是实际结果会导致人物的造型与动作同样也受到了影响。至于具体的影响可以通过在指令中单独使用她的名字来进行测试。【翻译注:只能说霉霉腿真是太长了,还老爱显摆】 由于动作和造型属于全局的绘画创作范畴,如果你只是想使用她的面容的话,你可以使用前文所提到的关键词混合技术来在扩散生成较靠后面步骤中实现单独对面部的修改。 艺术家名字的关联效应使用艺术家名字关键词,通常最能够体现出关联效应来。 在创作肖像绘画时,来自捷克的19世纪绘画家Alphonse Mucha(慕夏)是一个非常受欢迎的关键词。因为他的名字有助于产生非常有趣的装饰风格背景,并且其画风与数字插图能够很好的融合在一起。  [Emma Watson:Taylor Swift:0.6] by Alphonse Mucha. Steps: 30嵌入式标签(Embeddings)也是关键词 [Emma Watson:Taylor Swift:0.6] by Alphonse Mucha. Steps: 30嵌入式标签(Embeddings)也是关键词Embeddings(后续简称标签), 是逆向构建(Textural Inversion)技术的所生成的新的关键词。其本质上相当于一些关键词的组合。在实际使用时,你可以预期获得比存粹的关键词组合更多的一些表现效果。【翻译注:完全按自己的理解瞎翻译了一下Textural Inversion这个词组,其技术原理其实很简单,可以参考这篇文章,简单看下都能理解,如果有更好的翻译欢迎指正】 我们来看一个在不使用标签时生成的钢铁侠做饭的示例图片:  Prompt: iron man cooking in kitchen. Prompt: iron man cooking in kitchen.Style-Empire 是一个我很喜欢使用的标签,因为它可以为肖像图片添加更深的色调,并且创造出很有趣的光照效果。由于这个标签是通过一组夜晚的街景图片所训练出来的,因此在使用时,你可以预期它将可能为你的图像添加一些黑色、建筑或是街景。下面看一下这个标签添加后的效果:  Prompt: iron man cooking in kitchen Style-Empire. Prompt: iron man cooking in kitchen Style-Empire.我们可以观察到一些有趣的效果: 第一张图片的背景变成的夜晚的城市建筑钢铁侠更倾向于展示他的面孔,也许因为训练的图片是个肖像图片?所以,即使一个标签原始的期望是去调整风格,它也仅仅是一组关键词,并且在实际使用时会产生一些意想不到的效果。 定制模型(custom model)的效果使用一个定制模型绝对是获取一种风格最为便捷的方式。这也是Stable Diffusion独特魅力。因为有大量的开源社区,上百个定制化模型可以让你免费的使用。 当使用一个模型时,我们需要注意的是关键词的作用有可能会发生变化,尤其是对于风格类的模型而言。 我们再来使用Henry Asencio做一个演示。在sd v1.5模型中,只使用他的名字会生成下面这样的图像:  使用 DreamShaper,一个针对于肖像画进行调优的定制化模型,当使用同样的关键词时,得到的结果是这样的:  这是个非常像样但风格完全不同的结果。这个模型对于生成清晰且漂亮的面容有着强烈的偏好。 所以在使用不同的模型时,要注意调整你对于常用关键词效果的认知。van Gogh(梵高)可能不再是van Gogh了。 |

【本文地址】