| pytorch梯度裁剪(Clipping Gradient):torch.nn.utils.clip | 您所在的位置:网站首页 › pytorch梯度裁剪设多少合理 › pytorch梯度裁剪(Clipping Gradient):torch.nn.utils.clip |

pytorch梯度裁剪(Clipping Gradient):torch.nn.utils.clip

|

?

1

torch.nn.utils.clip_grad_norm(parameters, max_norm, norm_type=2)

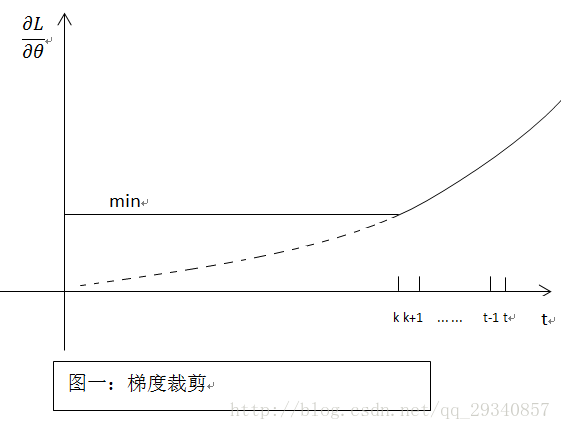

1、梯度裁剪原理(http://blog.csdn.net/qq_29340857/article/details/70574528) 既然在BP过程中会产生梯度消失/爆炸(就是偏导无限接近0,导致长时记忆无法更新),那么最简单粗暴的方法,设定阈值,当梯度小于/大于阈值时,更新的梯度为阈值,如下图所示: 优点:简单粗暴 缺点:很难找到满意的阈值 2、nn.utils.clip_grad_norm(parameters, max_norm, norm_type=2) 这个函数是根据参数的范数来衡量的 Parameters: parameters (Iterable[Variable]) – 一个基于变量的迭代器,会进行归一化(原文:an iterable of Variables that will have gradients normalized)max_norm (float or int) – 梯度的最大范数(原文:max norm of the gradients)norm_type(float or int) – 规定范数的类型,默认为L2(原文:type of the used p-norm. Can be'inf'for infinity norm) |

【本文地址】

公司简介

联系我们