| Transformer模型 | 您所在的位置:网站首页 › one-liner什么意思 › Transformer模型 |

Transformer模型

|

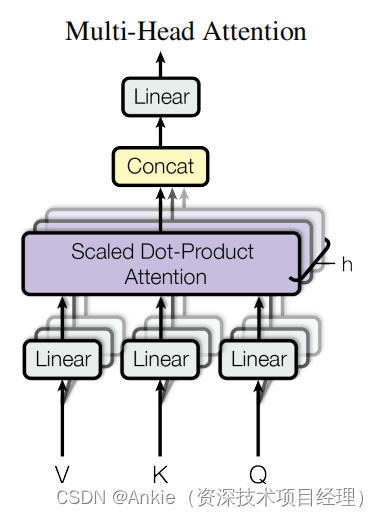

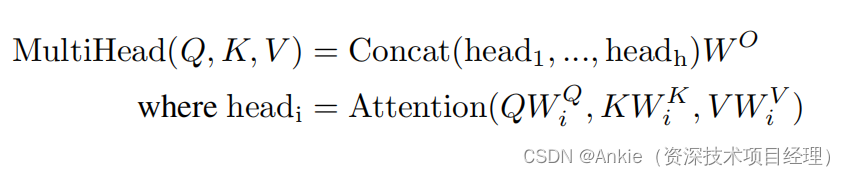

线性层 Linear 在transformer模型里面遍地都是,今天介绍一下线性层(Linear Layer)

线性层(Linear Layer)是神经网络中的一种基本层,也被称为全连接层(Fully Connected Layer)或密集层(Dense Layer)。线性层在神经网络中起到的作用是对输入数据进行线性变换。 线性层的基本操作可以表示为: (y = Wx + b) 其中: (y) 是输出向量。(W) 是权重矩阵,其中的每个元素都是可学习的参数。(x) 是输入向量。(b) 是偏置向量,也是一个可学习的参数。线性层会对输入数据 (x) 进行线性组合,并通过加上偏置 (b) 得到输出 (y)。权重矩阵 (W) 定义了输入和输出之间的线性关系。 线性层在神经网络中扮演着重要的角色。它们可以连接不同层的神经元,实现信息的传递和转换。在神经网络的前向传播过程中,输入数据经过一系列线性层和非线性激活函数的组合,最终得到网络的输出。 需要注意的是,虽然线性层只能执行线性变换,但整个神经网络由于包含了非线性激活函数,因此可以逼近复杂的非线性函数。这使得神经网络能够学习并处理各种复杂的模式和任务。 总结来说,线性层是神经网络中执行线性变换的基本层,通过权重矩阵和偏置向量的作用,将输入数据转换为输出数据,并与其他层连接构建复杂的神经网络结构。 最佳拟合线

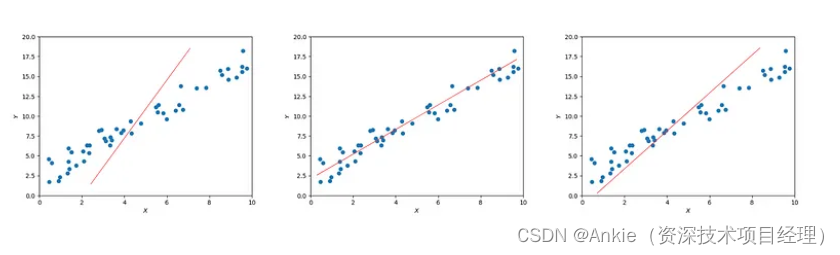

最佳拟合线是最能准确表示一组点的方程。对于给定的输入,方程的输出应该尽可能接近期望的输出。 在上面的图像中,很明显中间的线比左边或右边的线更能拟合蓝色的点。通过回归的数学方式为一组点识别出最佳拟合线。 简单的说就是,算出权重W 和B 得出最佳拟合线。 transformer里面的应用:

1,W*权重矩阵就是线性层训练的目的,就是要找到合适的W*(weights)。 2,W* 是函数nn.Linear初始化的,默认为随机数。经过不断地训练,更新,最终获得比较好的结果 原文链接: 学习transformer模型-权重矩阵Wq,Wk,Wv的简明介绍-CSDN博客 https://medium.com/@hunter-j-phillips/a-simple-introduction-to-regression-and-machine-learning-in-python-5e6bd76b0bf8 |

【本文地址】