| 基于卷积长短时记忆深度神经网络的带内全双工非线性数字自干扰消除 | 您所在的位置:网站首页 › fdd是全双工吗 › 基于卷积长短时记忆深度神经网络的带内全双工非线性数字自干扰消除 |

基于卷积长短时记忆深度神经网络的带内全双工非线性数字自干扰消除

|

路 雷 褚建军 唐燕群* 陶业荣 伍哲舜 郑承武 陈 琦 ①(中国电子科技集团公司第三十六研究所 嘉兴 314033) ②(中山大学电子与通信工程学院 深圳 518107) ③(中国人民解放军63891部队 洛阳 471000) ④(中山大学系统科学与工程学院 广州 510275) ⑤(西南科技大学信息工程学院 绵阳 621000) 1 引言移动数据流量的爆炸式增长对可用频谱资源提出了挑战。带内全双工(In-Band Full Duplex,IBFD)技术凭借其同时发送和接收的能力能够有效提高频谱利用率,近年来引起了研究学者的广泛关注[1,2]。然而,IBFD系统中在同一时间和同一频段发送和接收信号会带来严重的自干扰(Self-Interference, SI)。为了消除或抑制自干扰,研究学者提出了模拟自干扰消除方法和数字自干扰消除方法。模拟自干扰消除方法是利用被动或主动抑制在模拟域中实现自干扰的消除,主要针对的是线性自干扰,而残余的非线性自干扰依然能通过接收机进入数字域。因此,诸多研究学者选择在数字域来研究非线性特性及其消除方法[3]。 与自干扰的线性部分相比,由发射(Transmit,Tx)和接收(Receive, Rx)链路损伤引起的非线性部分更难消除。在Tx链路中,主要的非线性由同相正交(In-phase and Quadrature, IQ)混频器和射频(Radio Frequency, RF)功率放大器(Power Amplifier, PA)产生;同样,Rx链路中的带内非线性,主要由低噪声放大器(Low Noise Amplifier, LNA)和IQ混频器引起。值得注意的是,信号模型中省略了数模转换器(Digital-to-Analog Converter,DAC)和模数转换器(Analog-to-Digital Converter,ADC)[4]产生的非线性以及相位噪声的影响。对于由PA非线性和IQ不平衡引起的非线性失真影响,使用最广泛的数字自干扰消除方法是基于多项式模型进行的。特别是针对PA具有记忆性的非线性行为模型——静态多项式、并行哈默斯坦(Parallel Hammerstein, PH)、渥尔特拉和径向基函数神经网络,文献[5]进行了比较分析。此外,文献[6,7]讨论了带PH的综合模型,并针对PA引起的非线性和IQ不平衡进行了数字自干扰消除处理。 近年来,随着神经网络技术的快速发展,基于神经网络的数字自干扰消除方法正在逐步替代多项式模型方法,用于数字域的非线性自干扰消除中。在文献[6]中,一个简单的全连接神经网络被用于数字对消,以较低的计算复杂度实现了相同的对消性能。基于通信基带信号是复数的本质,文献[8,9]采用复值神经网络(Complex Valued Neural Network,CVNN)进行自干扰消除,其中权重、偏差和激活函数等变量都是复数。 综上讨论,传统基于多项式模型的方法需要结合相关先验知识来建立数学模型以刻画非线性效应,之后再通过信道估计方法来获得模型参数,重建自干扰信号。由于极其依赖相关先验知识,如果发生模型失配的情况,将会导致消除效果严重恶化,因而人工设计模型估计相关参数的方法效率较为低下。此外,全连接神经网络仅仅是利用了多层感知机与非线性激活函数具有一定程度能够减少特征提取过程以及对待拟合函数非线性近似的能力,而无法针对高维数据特有的空频相关性、时间相关性等特点进行处理。因此,基于多项式模型和神经网络的非线性自干扰消除方法无法满足IBFD系统的性能要求,亟需研究新型的数字自干扰消除方法。 受卷积神经网络(Convolutional Neural Network,CNN)和递归神经网络(Recurrent Neural Network,RNN)的设计思想所启发,本文基于卷积长短时记忆深度神经网络(Convolutional Long short-term memory Deep Neural Networks, CLDNN),提出了两个新颖的网络结构来提高IBFD系统的非线性自干扰消除性能,分别为实部虚部2维神经网络(Two-Dimensional-Convolutional Long short-term memory Deep Neural Networks, 2D-CLDNN)和复数值CLDNN(Complex-Value-Convolutional Long short-term memory Deep Neural Networks, CVCLDNN)。文献[10–12]将CLDNN首次用于调制分类、语音搜索和异常识别任务,它结合了CNN、长短时记忆网络(Long Short-Term Memory, LSTM)和深度神经网络(Deep Neural Network, DNN)的优点。由于RF设备产生的记忆长度的非线性部分,数字干扰消除的任务与时间相关问题紧密相连。通过将训练样本输入神经网络,可以较为容易地重建非线性自干扰。此外,具有高维特征和高度非线性的自干扰很难通过建模来处理,而CNN在解决传统数学模型难以解决的问题方面具有优势。因此,将CLDNN应用于非线性数字对消有望获得较好的性能。在IBFD系统中,实验结果与传统方法相比,表明所提出的两种新的CLDNN方法在消除自干扰性能方面显著优于传统方法。其中,与全连接深度神经网络等传统方法的基准相比,所提出的方案可以实现至少26%的非线性自干扰消除改进。此外,本文所提CLDNN方法只需要显著减少训练轮数就能保证相同的自干扰消除性能。 本文的其余部分安排如下:第2节简要描述了IBFD系统的基带等效信号模型,并回顾了传统自干扰消除方法;第3节介绍了所提出的2D-CLDNN和CV-CLDNN结构;第4, 5节进行了实验结果分析和全文总结。 2 基带等效信号模型

图1 所提出的基带等效信号模型的框图 多项式模型能够表征RF损伤的非线性效应,尤其是PA非线性和IQ不平衡[6,7],其显著非线性失真主要在多项式非线性抵消模型中讨论[4,5]发送端和接收端的数字基带信号用x(n)和y(n)表示。M,L和P的参数分别表示PA的记忆长度、hSI的多径长度和PH模型的非线性阶数。 除基于多项式模型的自干扰消除方法之外,已有基于神经网络的方法主要包括实值神经网络(Real-Valued Neural Network, RVNN)[7]和CVNNsplit[8,9]。由全连接层组成的RVNN包含3种类型的节点,分别称为输入节点、隐藏节点和输出节点。在处理复数值数据时,例如通信基带信号,需要将所有复数值拆分为实部和虚部。输入节点的大小与射频设备和无线信道的自干扰信道响应的总长度有关,有两个输出节点代表估计的自干扰信号的实部和虚部。通过使用来自参考信号数据集的训练样本,可以将网络的所有权重训练为最优。而基于CVNN-split的神经网络结构旨在通过模仿复数网络结构,将信号的实部和虚部分别馈送到不同的神经元,然后再分别使用实值激活函数进行处理。便于分析,下文中将实值激活函数命名为ReLU,并称此网络为CVNN-splitReLU。 3 基于CLDNN的数字自干扰消除凭借将低维特征映射到更高空间以实现更强大表达能力的优势,CNN不仅在图像分类方面,而且在视频检测和文本理解方面都被认为是一种有用的方法。与之不同的是,RNN在时间相关性任务中表现得更好,已被确定为应对自然语言处理问题的首选。而对于无线通信而言,越来越多的研究将其应用在自动调制分类(Adaptive Modulation and Coding, AMC)[10,12,13]、信道估计、信道状态信息反馈[14,15]中。依赖于CNN和RNN这两个网络在空间和时间特征提取方面的能力,可以通过深度学习将二者结合起来从而提高数字对消的性能。 经典的CNN网络结构由不同类型的层组成,例如池化层、卷积层等。由卷积滤波器(或核)组成的卷积层能够通过其特征平移不变特性从原始数据中提取主要特征,并且这些滤波器在整个时频空间中共享。通过卷积层和池化层,具有高维特征的原始数据将通过降维过程发送到下一层[12]。通过循环结构将以前和现在的数据连接,RNN适合处理具有显著时间相关性的时间序列数据。随着深度学习的快速发展,LSTM可用来解决梯度消失问题。 通过综合CNN和LSTM的优点,CLDNN更适合消除IBFD系统中由射频损伤引起的具有高维特征和高度非线性的自干扰。CLDNN是由CNN,LSTM和DNN级联组合而成的神经网络结构,其中,CNN可以减小频率的偏移变化,LSTM则很适合对时序语音进行建模,DNN可以对特征进行非线性映射到一个抽象空间从而进行有效分离。因此,本文利用以下两种CLDNN结构进行非线性数字干扰消除。 3.1 2D-CLDNN结构2D-CLDNN的设计源于图像处理领域中处理多通道图像的方案,在算法设计中引入3维张量,其中各维度分别表征原始数据的样本量、M+L(M和L分别代表PA的记忆长度和hSI的多径长度)与实虚部。2D-CLDNN不需要针对基带信号的实部虚部分别设计神经网络输入层,因此能大大减少待估计的网络参数,同时显著提高每轮训练速度。 基于2D-CLDNN的自干扰消除方法首先将数据的实部和虚部分开,然后分别传输到RVNN中的两个神经元中,从而构建3维张量来表示本文的训练样本。在图像处理中,需要将具有多通道特征的灰度图像或彩色图像转换为多维张量,以便后期更好地处理。同样,本文构建的张量有3个维度,分别代表样本的大小、自干扰通道响应的记忆长度以及表示基带信号的实部和虚部的两个“颜色通道”。与不使用特征工程而直接使用CNN的方法相比,后者减小了输入层的大小,从而显著减少了所需的训练时间。此外,CNN能够捕捉到一个基带信号的整体特征而不忽略相位信息,因此本文将一个基带信号作为处理一个多通道图像的工具。 将经历特征提取和降维后的样本作为下一个LSTM层的输入,该层能够处理记忆长度效应的时间相关性。之后,一个全连接层连接到LSTM层,输出层有两个神经元,分别代表评估自干扰信号的实部和虚部。整个网络结构如图2所示。ReLU作为激活函数,网络采用均方误差作为损失函数,因此该任务可以看作一个回归问题。

图2 2D-CLDNN结构 卷积层由25个大小为1×8的过滤器(窗口长度为8的1维过滤器)组成,并相应使用一个最大池化层。该层以32个单元和0.09的丢失率连接到LSTM层,并且LSTM层连接到一个与文献[6]中的基线相同的大小为17的密集全连接层,该层分别连接到用作两个输出层的两个密集层。 3.2 CV-CLDNN结构CVNN结构经常被用于处理通信基带信号[8,9,16],其诸多变体主要可以分为两种类型:一种是完全配备复数参数,包括权重、激活函数等;另一个是实虚分离型激活函数,将输入层的实部和虚部分别输入不同的实值激活函数,以满足复杂运算的需求。受文献[17]中的思想启发,本文提出了一种基于CV-CLDNN的非线性数字自干扰消除方法,与RVNN类似,该网络也将样本分为实部和虚部两个输入层,然后分别输入所述卷积层进行复卷积,得到实部复卷积层和虚部复卷积层,再进行级联,完成所述训练模型,得到输出信号。 通过CV-CLDNN通过复卷积核与输入样本的实部虚部进行模仿复数运算的复卷积运算,同样充分考虑了复基带信号包含的相位信息,更好地对自干扰信号进行刻画和重建。假设对复数输入样本z=x+iy进行卷积,其中x和y通过复数滤波器W=A+iB(A,B代表复卷积核)表示该样本的实部和虚部。因此,通过卷积上面提到的两个对象,可以得到

其中,⊗表示卷积运算。经过这种复杂的卷积运算和复杂的激活函数处理后,样本最终被送入下一个LSTM层、全连接隐藏层和输出层。整个CV-CLDNN如图3所示。

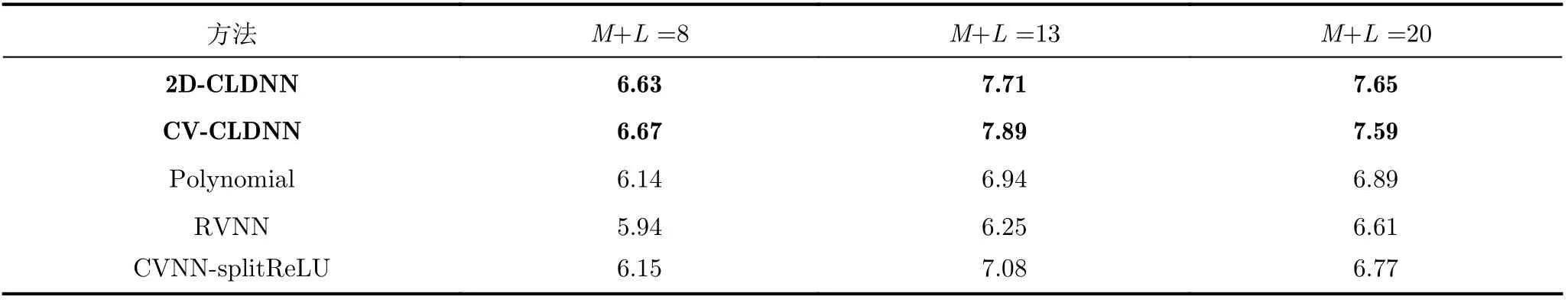

图3 CV-CLDNN结构 4 实验结果本节首先将自干扰信号数据集用于上述训练模型,然后本文展示了这些非线性数字对消方法包括本文提出的CLDNN(2D-CLDNN和CV-CLDNN),CVNN-splitReLU, RVNN和多项式模型的性能比较结果。与文献[6]中将M+L(PA记忆长度M与自干扰信道多径长度L之和)设置为固定值不同,本文使用不同的值来评估这些不同的方法,以反映无线信道和射频损伤中的动态环境。 为了公平地比较本文的网络与传统方法之间的非线性自干扰消除性能,决定使用Github中[6]共享的数据集,并通过最小二乘法(Least Square,LS)抵消线性部分。便于分析,以下自干扰消除性能是指LS处理后的非线性自干扰消除性能。该数据集由正交频分复用(Orthogonal Frequency-Division Multiple, OFDM)信号组成,这些信号经过正交相移键控(Quadrature Phase Shift Keying,QPSK)调制。更多关于数字抵消前模拟抵消的方法和硬件采集信号的参数可以从文献[6]中获得。 4.1 参数设置对于多项式模型,文献[6]将非线性阶数设置为P=7,并且考虑了3种不同条件下的M+L。而对于RVNN,全连接神经网络是通过使用Python的Keras框架实现的。输入单元的大小为2(M+L),作为基线的隐藏单元的大小为17。将λ=0.004的学习率设置为与文献[6]相同,并将不同的批量梯度下降大小设置为B=256,以便更好地训练本文的模型,防止过度拟合,同时尽最大努力保持与基线一致。CVNN-splitReLU的相关参数与RVNN相同,但它使用ReLU作为激活函数。两个CLDNN的网络结构见上文第3节。 2D-CLDNN由1个具有3维张量的输入层、1个具有Wnum=25个Wsize=8的滤波器的卷积层、1个最大池化层、1个具有32个单元的LSTM层以及其他与RVNN相同的层组成。CV-CLDNN与2D-CLDNN不同,它的输入层大小与RVNN相同,并且有4个卷积层,可以满足复杂算子的模拟。 4.2 性能分析从表1的数据来看,当将M+L=13设置为与文献[6]相同时,不难发现复数神经网络在重构自干扰信号的非线性部分时产生了最佳性能。很明显,2D-CLDNN和CV-CLDNN在这两种情况下都比其他传统方法表现更好。更重要的是,RVNN在这两种情况下平均表现最差。另外,多项式模型的性能可以逼近CVNN-splitReLU,甚至在内存长度设置为20时超过它。一般来说,本文基于CLDNN提出的两个网络结构在非线性数字自干扰消除性能方面表现最佳,主要体现在以下两个方面:一是本文提出的两个CLDNN的非线性自干扰消除性能能够达到大约8 dB,但对于RVNN,它低于7 dB。此外,本文提出的两个CLDNN是稳健的,因为它们的非线性自干扰消除性能不受不同环境(例如不同的无线信道和RF损伤)的严重影响。

表1 各方法在M+L不同条件下的非线性自干扰消除性能(dB) (1)M+L=13:根据文献[6],M+L=13被认为是匹配多项式模型以达到最佳抵消性能的最佳情况,RVNN也遵循相同的设置。因此,为了将本文的网络结构与其他传统网络进行比较,本文首先将M+L=13作为基线。在图4中,在线性抵消之后,本文提出的两个CLDNN网络结构的非线性自干扰消除性能最终通过总共60次训练轮数接近8 dB。此外,可以发现,仅在大约3个时期之后,这两个CLDNN网络结构就实现了7 dB的非线性自干扰消除,这是传统RVNN最终无法达到的性能。此外,CVNN-splitReLU的性能优于RVNN,但仍无法与两个CLDNN网络结构相媲美。然而,这两个CLDNN网络结构在测试数据上的表现不如其他网络稳定的原因是本文提出的网络更复杂,相关参数的数量也更多。因此,本文的网络存在一些过度拟合是很正常的。然而,有许多方法被普遍认为是克服深度学习中过度拟合的有用工具,例如调整学习率、批量大小、训练轮数等。事实上,本文采用了更多的训练策略来使这两个CLDNN网络结构的性能在训练集和测试集上保持一致。但是为了保持比较的公平性,不愿意过多地改变相关参数,并且这两种CLDNN在非线性自干扰消除性能方面明显优于其他方法。

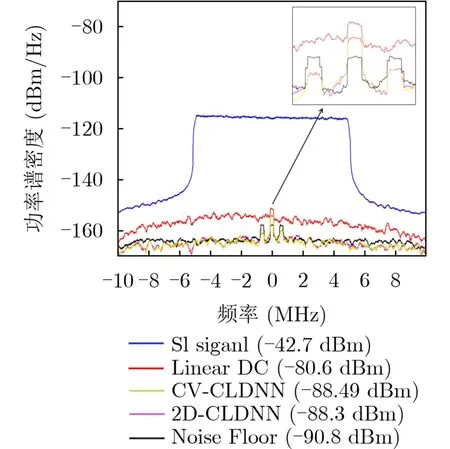

图4 当M+L=13时,非线性自干扰消除性能(dB)与训练轮数的关系 在图5中,很明显,本文提出的方法在进行非线性抵消后,抵消性能都达到了大约8 dB,并且非常接近接收机的底部噪声。

图5 自干扰信号与进行线性/非线性抵消后的功率谱密度 如上所述,M+L的长度由两部分组成,M与PA的记忆长度有关,L代表自干扰信道多径的长度。信号带宽和信道条件对多径效应都有影响。有一些特定的无线信道由于散射环境丰富,影响L值。例如,在IEEE802.16e系统中,20 MHz带宽下的44.64 ns采样间隔远小于多径信道下2510 ns的延迟扩展。因此本文假设带宽是固定的,而无线信道是动态的,因此M+L的值不是一个固定的常数。所以,除了M+L=13之外,本文还选择了M+L=8和M+L=20,以证明本文提出的两个网络是稳固的,并且仍然比其他传统方法表现更好。 (2)M+L=8:在这种情况下,4个网络的非线性自干扰消除性能变得更差。从图6可以发现,这两个CLDNN的非线性抵消在60次训练轮数后也可以达到大约7 dB。CVNN-splitReLU表现稍差。然而,RVNN的非线性自干扰消除非常接近6 dB,并且在这些网络中表现相对稳定。

图6 当M+L=8时,非线性自干扰消除性能(dB)与训练轮数的关系 (3)M+L=20:从图7可以看到所提出的两个CLDNN的抵消大约达到8 dB,与第1种情况一样有轻微的波动,并且仍然比其他网络表现更好。CVNN-splitReLU在测试集上的表现比其他情况差,RVNN的性能还不能超过7 dB。但是可以发现这4个网络的性能并没有下降,这表明神经网络具有适应时变信道环境的能力。

图7 当M+L=20时,非线性自干扰消除性能(dB)与训练轮数的关系 5 结论CLDNN网络结构在卷积层可以充分利用复基带信号的实部虚部联合特性,且考虑复数的相位信息,因此能更加逼近自干扰信号的本质以更好地对信号进行近似。卷积层输出的信号输入到LSTM层后,算法充分利用LSTM特有的处理时间序列任务的优势,准确地反映了自干扰信号具有时间相关性的特点。与传统非线性数字自干扰消除方法相比,本文基于CLDNN提出的2D-CLDNN和CV-CLDNN在PA记忆长度和自干扰信道多径长度满足M+L=13时,通过总共60次训练轮数,两种卷积长短时记忆深度神经网络的自干扰消除性能增益达8 dB。在后续的研究工作中,将在非线性数字自干扰消除中考虑采用更为先进的全连接网络,为IBFD系统的收发同时能力提供技术支撑。 猜你喜欢 实部基带网络结构 复数知识核心考点综合演练中学生数理化·高一版(2022年3期)2022-04-15磁感应介电常数法测量脑出血的可行性研究医疗卫生装备(2021年5期)2021-06-04Ag元素对Ni-7at.%W合金基带织构形成的影响兰州理工大学学报(2021年1期)2021-03-09快递网络结构研究进展西安邮电大学学报(2020年1期)2020-12-17例谈复数应用中的计算两次方法数学学习与研究(2020年23期)2020-01-11苹果推出自研基带芯片要过几道坎?中国电子报(2019年55期)2019-10-24基于AutoML的保护区物种识别①计算机系统应用(2019年9期)2019-09-24苹果10亿美元为5G买“芯”通信产业报(2019年26期)2019-08-30LTE基带芯片规模超过总基带芯片出货量办公自动化(2016年20期)2016-12-18浅谈正Γ型匹配网络的设计卷宗(2016年8期)2016-11-15

|

【本文地址】

电子与信息学报2022年11期

电子与信息学报2022年11期