YOLOV5训练自己的无人车避坑(障)系统 |

您所在的位置:网站首页 › 无人机入坑指南最新版 › YOLOV5训练自己的无人车避坑(障)系统 |

YOLOV5训练自己的无人车避坑(障)系统

|

一、环境配置

1.安装好显卡驱动,如:CUDA; 2.配置好pytorch1.7及以上版本的python3,尽量安装GPU和CPU通用的pytorch 这部分我不详细讲述,各位哥可以上网找找别的教程。 二、YOLOV5的实现训练 1.下载好YOLOv5的框架,并在python的IDE中打开,如:pycharm这里给出最新版官方的框架下载地址: https://github.com/ultralytics/yolov5 我也给出我使用的框架的下载地址,可能不是最新的,但是对于本教程来说是有用的 yolov5-master.zip_树莓派部署yolov5,yolov5树莓派-深度学习文档类资源-CSDN下载 2.数据集获取个人推荐在Kaggle上找数据集,质量和数量都比较高,这里给出地址 Find Open Datasets and Machine Learning Projects | Kaggle 当然,自己制作数据集也是可以的,但是数据集的质量可能会影响到目标检测系统的准确度,我这里就不主要说明如何制作VOC数据集了,各位哥可以上网查找。 本次我使用的是一个检测地面坑洼的VOC数据集,这里给出下载地址: 路面坑洼识别.zip的VOC数据集-深度学习文档类资源-CSDN下载 3.开始训练自己的数据集 1.按照以下的布局新建好对应的文件夹,本身自带的也不用删除,只增不减 ├── data │ ├── Annotations 进行 detection 任务时的标签文件,xml 形式,文件名与图片名一一对应 │ ├── images 存放 .jpg 格式的图片文件 │ ├── ImageSets 存放的是分类和检测的数据集分割文件,包含train.txt, val.txt,trainval.txt,test.txt │ ├── labels 存放label标注信息的txt文件,与图片一一对应 ├── ImageSets(train,val,test建议按照8:1:1比例划分) │ ├── train.txt 写着用于训练的图片名称 │ ├── val.txt 写着用于验证的图片名称 │ ├── trainval.txt train与val的合集 │ ├── test.txt 写着用于测试的图片名称

将下载好的数据集解压,得到 Annotations 和 images 文件夹

annotations文件夹中有 xml 文件

images 文件夹 中有对应的图片

将解压好的文件对号入座地复制到YOLOV5框架中Date下的Annotations 和 images 文件夹中 2.对数据集进行初步处理A.在yolov5的根目录下新建一个文件ChangeName.py,代码如下: import os #任何格式的文件都适用 path = "D:\pyCharmdata\Pothole_detection_YOLOV5\data\images" filelist = os.listdir(path) count=0 for file in filelist: print(file) for file in filelist: Olddir=os.path.join(path,file) if os.path.isdir(Olddir): continue filename=os.path.splitext(file)[0] filetype=os.path.splitext(file)[1] Newdir=os.path.join(path,str(count).zfill(6)+filetype) os.rename(Olddir,Newdir) count+=1将path = "。。"这行分别改成YOLOv5框架的data下images和Annotations的地址,并且各运行一次,将所有的xml和图片对应地重命名一次,得

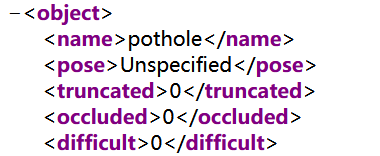

B.在yolov5的根目录下新建一个文件IntoJPG.py,代码如下: # -*- coding: utf-8 -*- """ Created on Fri Jul 19 10:39:03 2019 @author: wsb """ import cv2 import os print('----------------------------------------------------') print('程序的功能为:将该目录下输入的文件内的图片转为指定格式') # 目前我测试了jpg转化为png和png转化为jpg。 print('转化结果保存在当前目录下的new_picture内') print('----------------------------------------------------') son = 'D:\pyCharmdata\Pothole_detection_YOLOV5\data\images' picture_type = 'jpg' #daddir = './' path = son newpath = "new_picture" if not os.path.exists(newpath): os.mkdir(newpath) path_list = os.listdir(path) number = 0 # 统计图片数量 for filename in path_list: number += 1 portion = os.path.splitext(filename) print('convert ' + filename + ' to ' + portion[0] + '.' + picture_type) img = cv2.imread(path + "/" + filename) cv2.imwrite("./" + newpath + "/" + portion[0] + '.' + picture_type, img) print("共转化了%d张图片" % number) print('转换完毕,文件存入 ' + newpath + ' 中') cv2.waitKey(0) cv2.destroyAllWindows()这里要自己修改 son =".." 和 newpath = ".." 的路径为要修改的图片的地址和修改后要存放的地址,将所有的图片都统一成 JPG 格式。 C.在yolov5的根目录下新建一个文件makeTxt.py,代码如下: import os import random trainval_percent = 0.9 train_percent = 0.9 xmlfilepath = 'data/Annotations' txtsavepath = 'data/ImageSets' total_xml = os.listdir(xmlfilepath) num = len(total_xml) list = range(num) tv = int(num * trainval_percent) tr = int(tv * train_percent) trainval = random.sample(list, tv) train = random.sample(trainval, tr) ftrainval = open('data/ImageSets/trainval.txt', 'w') ftest = open('data/ImageSets/test.txt', 'w') ftrain = open('data/ImageSets/train.txt', 'w') fval = open('data/ImageSets/val.txt', 'w') for i in list: name = total_xml[i][:-4] + '\n' if i in trainval: ftrainval.write(name) if i in train: ftrain.write(name) else: fval.write(name) else: ftest.write(name) ftrainval.close() ftrain.close() fval.close() ftest.close()由此,将数据集划分。 D.接着再新建另一个文件voc_label.py,切记,classes=[……] 中填入的一定要是自己在数据集中所标注的类别名称,标记了几个类别就填写几个类别名,我这里只有一个类别,故只填了一个'pothole'。类别的查看可以用浏览器打开对应的XML文件,name那一行对应的就是类别。

填写错误的话会造成读取不出xml文件里的标注信息。代码如下: # xml解析包 import xml.etree.ElementTree as ET import pickle import os # os.listdir() 方法用于返回指定的文件夹包含的文件或文件夹的名字的列表 from os import listdir, getcwd from os.path import join sets = ['train', 'test', 'val'] classes = ['pothole'] # 进行归一化操作 def convert(size, box): # size:(原图w,原图h) , box:(xmin,xmax,ymin,ymax) dw = 1./size[0] # 1/w dh = 1./size[1] # 1/h x = (box[0] + box[1])/2.0 # 物体在图中的中心点x坐标 y = (box[2] + box[3])/2.0 # 物体在图中的中心点y坐标 w = box[1] - box[0] # 物体实际像素宽度 h = box[3] - box[2] # 物体实际像素高度 x = x*dw # 物体中心点x的坐标比(相当于 x/原图w) w = w*dw # 物体宽度的宽度比(相当于 w/原图w) y = y*dh # 物体中心点y的坐标比(相当于 y/原图h) h = h*dh # 物体宽度的宽度比(相当于 h/原图h) return (x, y, w, h) # 返回 相对于原图的物体中心点的x坐标比,y坐标比,宽度比,高度比,取值范围[0-1] # year ='2012', 对应图片的id(文件名) def convert_annotation(image_id): ''' 将对应文件名的xml文件转化为label文件,xml文件包含了对应的bunding框以及图片长款大小等信息, 通过对其解析,然后进行归一化最终读到label文件中去,也就是说 一张图片文件对应一个xml文件,然后通过解析和归一化,能够将对应的信息保存到唯一一个label文件中去 labal文件中的格式:calss x y w h 同时,一张图片对应的类别有多个,所以对应的bunding的信息也有多个 ''' # 对应的通过year 找到相应的文件夹,并且打开相应image_id的xml文件,其对应bund文件 in_file = open('data/Annotations/%s.xml' % (image_id), encoding='utf-8') # 准备在对应的image_id 中写入对应的label,分别为 # out_file = open('data/labels/%s.txt' % (image_id), 'w', encoding='utf-8') # 解析xml文件 tree = ET.parse(in_file) # 获得对应的键值对 root = tree.getroot() # 获得图片的尺寸大小 size = root.find('size') # 如果xml内的标记为空,增加判断条件 if size != None: # 获得宽 w = int(size.find('width').text) # 获得高 h = int(size.find('height').text) # 遍历目标obj for obj in root.iter('object'): # 获得difficult ?? difficult = obj.find('difficult').text # 获得类别 =string 类型 cls = obj.find('name').text # 如果类别不是对应在我们预定好的class文件中,或difficult==1则跳过 if cls not in classes or int(difficult) == 1: continue # 通过类别名称找到id cls_id = classes.index(cls) # 找到bndbox 对象 xmlbox = obj.find('bndbox') # 获取对应的bndbox的数组 = ['xmin','xmax','ymin','ymax'] b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text), float(xmlbox.find('ymax').text)) print(image_id, cls, b) # 带入进行归一化操作 # w = 宽, h = 高, b= bndbox的数组 = ['xmin','xmax','ymin','ymax'] bb = convert((w, h), b) # bb 对应的是归一化后的(x,y,w,h) # 生成 calss x y w h 在label文件中 out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n') # 返回当前工作目录 wd = getcwd() print(wd) for image_set in sets: ''' 对所有的文件数据集进行遍历 做了两个工作: 1.将所有图片文件都遍历一遍,并且将其所有的全路径都写在对应的txt文件中去,方便定位 2.同时对所有的图片文件进行解析和转化,将其对应的bundingbox 以及类别的信息全部解析写到label 文件中去 最后再通过直接读取文件,就能找到对应的label 信息 ''' # 先找labels文件夹如果不存在则创建 if not os.path.exists('data/labels/'): os.makedirs('data/labels/') # 读取在ImageSets/Main 中的train、test..等文件的内容 # 包含对应的文件名称 image_ids = open('data/ImageSets/%s.txt' % (image_set)).read().strip().split() # 打开对应的2012_train.txt 文件对其进行写入准备 list_file = open('data/%s.txt' % (image_set), 'w') # 将对应的文件_id以及全路径写进去并换行 for image_id in image_ids: list_file.write('data/images/%s.jpg\n' % (image_id)) # 调用 year = 年份 image_id = 对应的文件名_id convert_annotation(image_id) # 关闭文件 list_file.close() # os.system(‘comand’) 会执行括号中的命令,如果命令成功执行,这条语句返回0,否则返回1 # os.system("cat 2007_train.txt 2007_val.txt 2012_train.txt 2012_val.txt > train.txt") # os.system("cat 2007_train.txt 2007_val.txt 2007_test.txt 2012_train.txt 2012_val.txt > train.all.txt") 3.YOLOV5框架文件的修改A.下载好YOLOV5的官方yolov5s,放到YOLOv5的根目录下 yolov5s和yolov5x.zip_yolov5s和yolov5x-深度学习文档类资源-CSDN下载 B.首先在data目录下,复制一份coco.yaml文件并将其重命名为Pothole_detection.yaml,放在data目录下,并对cat.yaml中的参数进行配置。其中train,val,test后面分别为训练集和测试集图片的路径, nc为数据集的类别数,我这里只分了1类,names为类别的名称。这几个参数均按照自己的实际需求来修改。代码如下: # COCO 2017 dataset http://cocodataset.org # Download command: bash yolov5/data/get_coco2017.sh # Train command: python train.py --data ./data/coco.yaml # Dataset should be placed next to yolov5 folder: # /parent_folder # /coco # /yolov5 # train and val datasets (image directory or *.txt file with image paths) train: data/train.txt # 118k images val: data/val.txt # 5k images test: data/test.txt # 20k images for submission to https://competitions.codalab.org/competitions/20794 # number of classes nc: 1 # class names names: ['pothole'] # Print classes # with open('data/coco.yaml') as f: # d = yaml.load(f, Loader=yaml.FullLoader) # dict # for i, x in enumerate(d['names']): # print(i, x)C.接着在models目录下找到yolov5s.yaml文件复制一份到date文件夹下进行修改,这里取决于你使用了哪个模型就去修改对于的文件,该项目中使用的是yolov5s模型。需要修改的代码如下: # parameters nc: 1 # number of classes depth_multiple: 0.33 # model depth multiple width_multiple: 0.50 # layer channel multiple这里只需修改nc:。。为你的种类数即可 D.修改yolov5代码,修改文件在 yolov5\utils\datasets.py 修改参数 num_workers为0 # Use torch.utils.data.DataLoader() if dataset.properties will update during training else InfiniteDataLoader() dataloader = loader(dataset, batch_size=batch_size, num_workers=0, sampler=sampler, pin_memory=True, collate_fn=LoadImagesAndLabels.collate_fn4 if quad else LoadImagesAndLabels.collate_fn) return dataloader, datasetE.修改train.py的一些参数 找到parse_pot函数

将 --cfg 和 --date 对应的两行的default 分别修改为你存放的文件地址,这里我是按照的地址来写的 将 train.py 中的下面这段 加上 encoding='utf-8' with open(data) as f: data_dict = yaml.safe_load(f) # data dict得: with open(data, encoding='utf-8') as f: data_dict = yaml.safe_load(f) # data dict 4.开始训练直接鼠标右键开始运行train.py进行训练 刚开始前面会报一些错误,但是不影响后续训练

A.找到run函数,将source对应的值修改为‘0’

B.找到parse_opt函数,将--weight 对应的地址修改为runs/train/.../weights/best.pt 若想要检测图片或者视频,并保存检测结果,只需把 --source 对应的 default修改为存放视频或者图片的地址,结果将保存在runs/detect/..下

若想实现实时检测,只需把 --source 对应的 default修改为对应摄像头的号码,若只有一个摄像头,则只需写‘0’即可,也可以用手机摄像头来进行检测,参考我的另一篇文章。 树莓派YOLOV5连接手机摄像头_Leonard2021的博客-CSDN博客 6.应用方向这里给出我训练好的识别系统,在配置好环境和路径后即可使用: Pothole_detection_YOLOV5.zip-深度学习文档类资源-CSDN下载 可以在上位机(PC、树莓派、jetson nano)中调试这个地面坑洼检测系统,再与下位机(如:arduino,stm32等)进行通讯,可实现简单的无人车路面避坑(避障),如: 树莓派官方系统与arduino通讯_Leonard2021的博客-CSDN博客_树莓派与arduino联合控制 到此本文结束。 |

【本文地址】

今日新闻 |

点击排行 |

|

推荐新闻 |

图片新闻 |

|

专题文章 |