Python 爬虫:requests 和 selenium 伪装 headers 和代理应对反爬机制 |

您所在的位置:网站首页 › Python访问网址如何伪装convas › Python 爬虫:requests 和 selenium 伪装 headers 和代理应对反爬机制 |

Python 爬虫:requests 和 selenium 伪装 headers 和代理应对反爬机制

|

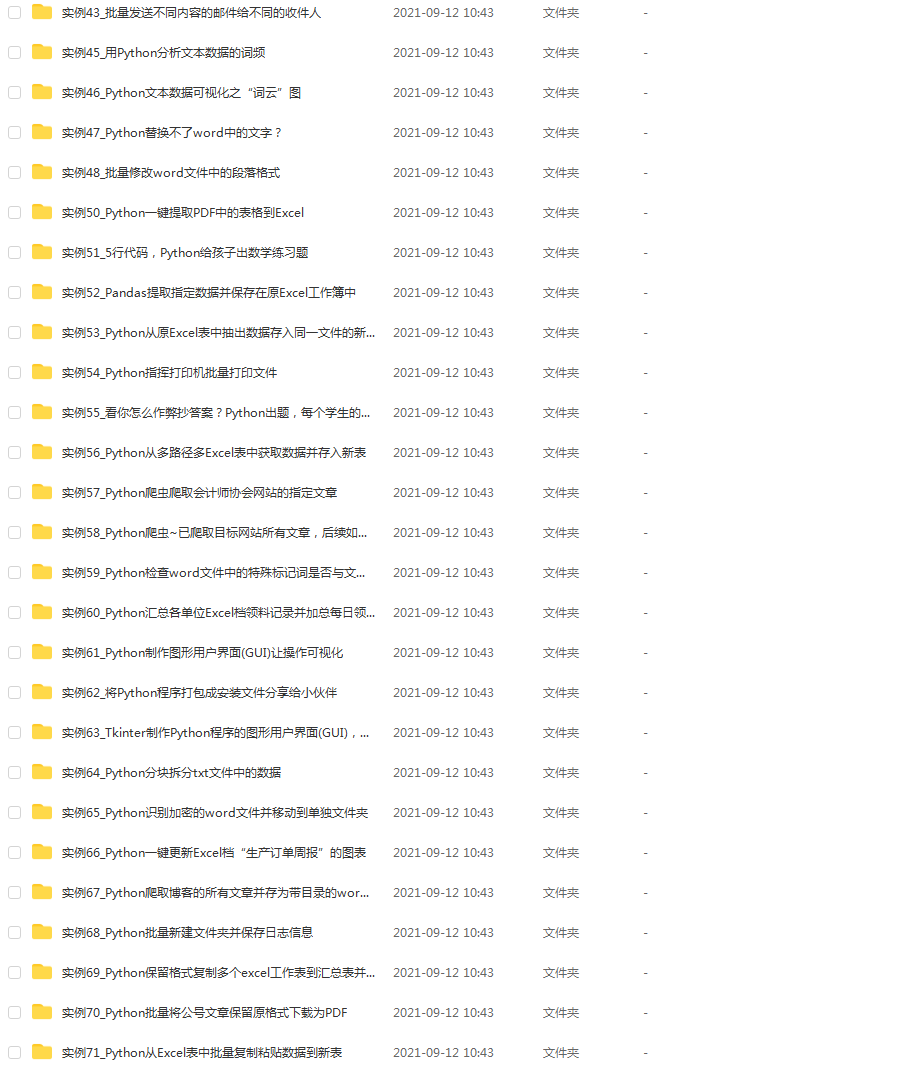

将上面的请求头复制下来,传给 requests.get() 函数,即可将请求伪装成浏览器。 import requests url = 'https://httpbin.org/headers' myheaders = { "Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8", "Accept-Encoding": "br, gzip, deflate", "Accept-Language": "zh-cn", "Host": "httpbin.org", "User-Agent": "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/12.0.3 Safari/605.1.15" } response = requests.get(url, headers=myheaders) if response.status_code == 200: print(response.text)返回的结果变成: { "headers": { "Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,*/*;q=0.8", "Accept-Encoding": "br, gzip, deflate", "Accept-Language": "zh-cn", "Host": "httpbin.org", "User-Agent": "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/12.0.3 Safari/605.1.15" } }在应用爬虫的时候,可以随机跟换其他 User-Agent 避免触发反爬。 2、selenium 模拟使用浏览器伪装 headers使用自动化测试工具 selenium 可以模拟使用浏览器访问网站。本文使用 selenium 3.14.0 版本,该版本支持 Chrome 和 Firefox 浏览器。要使用浏览器需下载对应版本的 driver。 Driver 下载地址: Browser Links ——— —————————————————————- Chrome https://sites.google.com/a/chromium.org/chromedriver/downloads Firefox https://github.com/mozilla/geckodriver/releases 使用 webdriver 访问本身自带浏览器的 headers。 from selenium import webdriver url = 'https://httpbin.org/headers' driver_path = '/path/to/chromedriver' browser = webdriver.Chrome(executable_path=driver_path) browser.get(url) print(browser.page_source) browser.close()打印出返回的网页代码: { "headers": { "Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,image/webp,image/apng,*/*;q=0.8", "Accept-Encoding": "gzip, deflate, br", "Accept-Language": "zh-CN,zh;q=0.9", "Host": "httpbin.org", "Upgrade-Insecure-Requests": "1", "User-Agent": "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/72.0.3626.121 Safari/537.36" } }浏览器 driver 也能伪装 User-Agent,只需在创建 webdriver 浏览器对象的时候传入设置即可: from selenium import webdriver url = 'https://httpbin.org/headers' user_agent = "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/12.0.3 Safari/605.1.15" driver_path = '/path/to/chromedriver' opt = webdriver.ChromeOptions() opt.add_argument('--user-agent=%s' % user_agent) browser = webdriver.Chrome(executable_path=driver_path, options=opt) browser.get(url) print(browser.page_source) browser.close()此时返回的 User-Agent 就变成传入的设置了。 { "headers": { "Accept": "text/html,application/xhtml+xml,application/xml;q=0.9,image/webp,image/apng,*/*;q=0.8", "Accept-Encoding": "gzip, deflate, br", "Accept-Language": "zh-CN,zh;q=0.9", "Host": "httpbin.org", "Upgrade-Insecure-Requests": "1", "User-Agent": "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/12.0.3 Safari/605.1.15" } }Firefox 浏览器 driver 的设置有所不同: from selenium import webdriver url = 'https://httpbin.org/headers' user_agent = "Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_6) AppleWebKit/605.1.15 (KHTML, like Gecko) Version/12.0.3 Safari/605.1.15" driver_path = '/path/to/geckodriver' profile = webdriver.FirefoxProfile() profile.set_preference("general.useragent.override", user_agent) browser = webdriver.Firefox(executable_path=driver_path, firefox_profile=profile) browser.get(url) print(browser.page_source) browser.close() 3、requests 使用 ip 代理发送请求当一个 ip 短时间访问太过频繁时,网站的反爬机制会被触发,将会要求输入验证码甚至封锁 ip 禁止访问。此时需要使用代理 ip 发起请求才可获取正确的网页。 访问 https://httpbin.org/ip 网址可以查看自己的 ip。 import requests url = 'https://httpbin.org/ip' response = requests.get(url) print(response.text)返回本机网络的ip: { "origin": "202.121.167.254, 202.121.167.254" }使用代理 IP 与1中伪装 headers 的方式相似,比如现在得到一个代理ip:58.58.213.55:8888,使用如下: import requests proxy = { 'http': 'http://58.58.213.55:8888', 'https': 'http://58.58.213.55:8888' } response = requests.get('https://httpbin.org/ip', proxies=proxy) print(response.text)返回的就是代理 ip { "origin": "58.58.213.55, 58.58.213.55" } 4、selenium webdriver 使用代理 ipchrome driver 使用代理 ip 的方式与伪装 user-agent 相似: from selenium import webdriver url = 'https://httpbin.org/ip' proxy = '58.58.213.55:8888' driver_path = '/path/to/chromedriver' opt = webdriver.ChromeOptions() opt.add_argument('--proxy-server=' + proxy) browser = webdriver.Chrome(executable_path=driver_path, options=opt) browser.get(url) print(browser.page_source) browser.close()打印结果: { "origin": "58.58.213.55, 58.58.213.55" }firefox driver 的设置略有不同,并且需要下载浏览器扩展 close_proxy_authentication 取消代理用户认证。可通过谷歌下载,本文使用 firefox 65.0.1 (64 位) 版本,可用的扩展文件是: [close_proxy_authentication-1.1-sm+tb+fx.xpi]。 文末有福利领取哦~👉一、Python所有方向的学习路线 Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。 👉二、Python必备开发工具

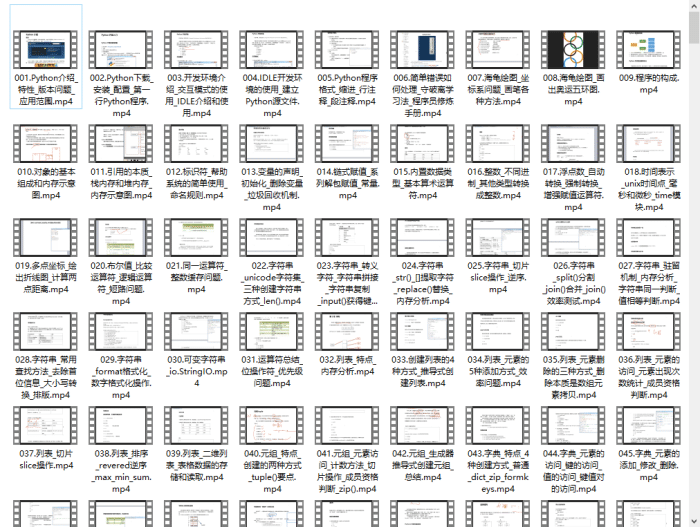

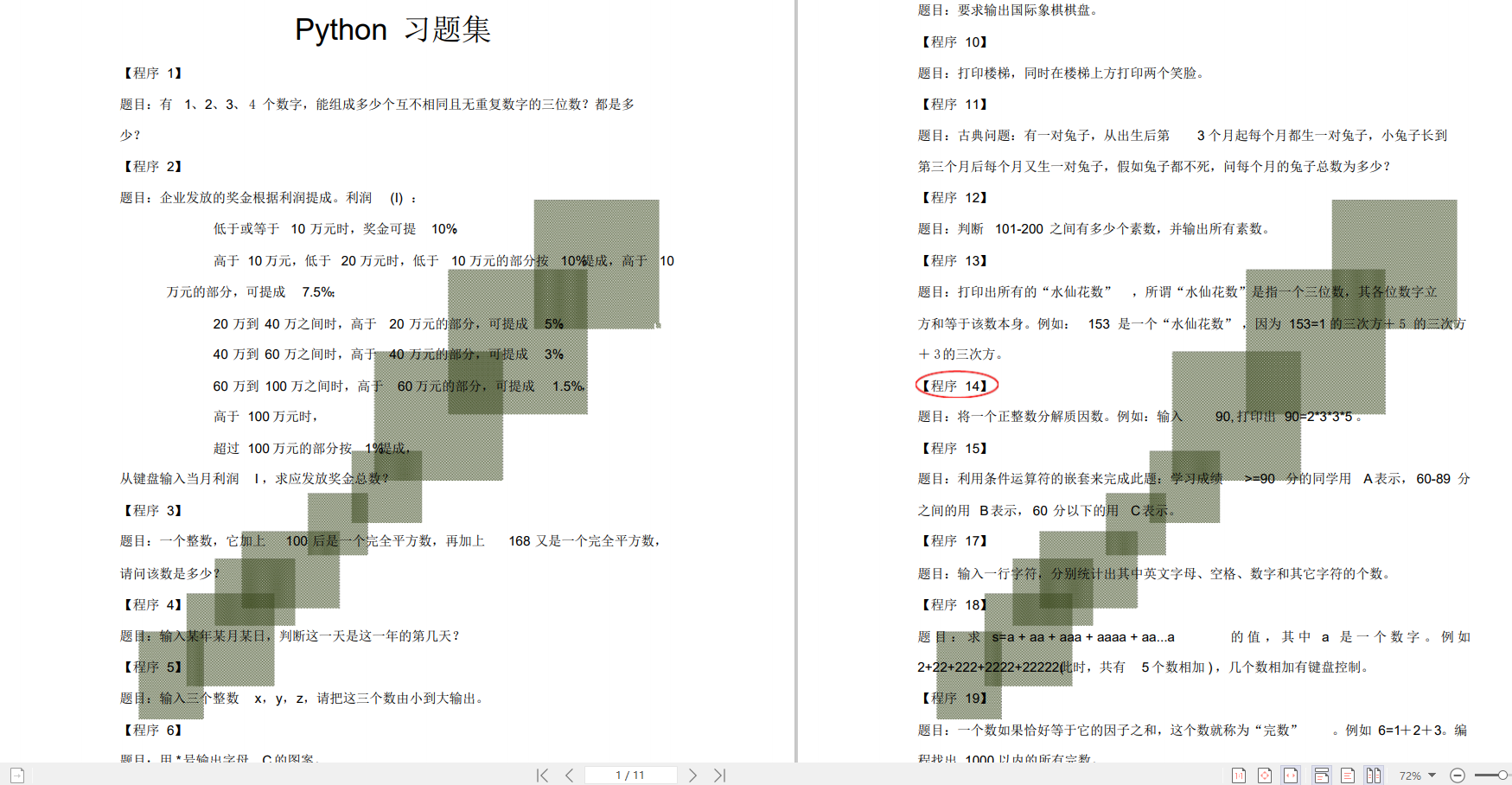

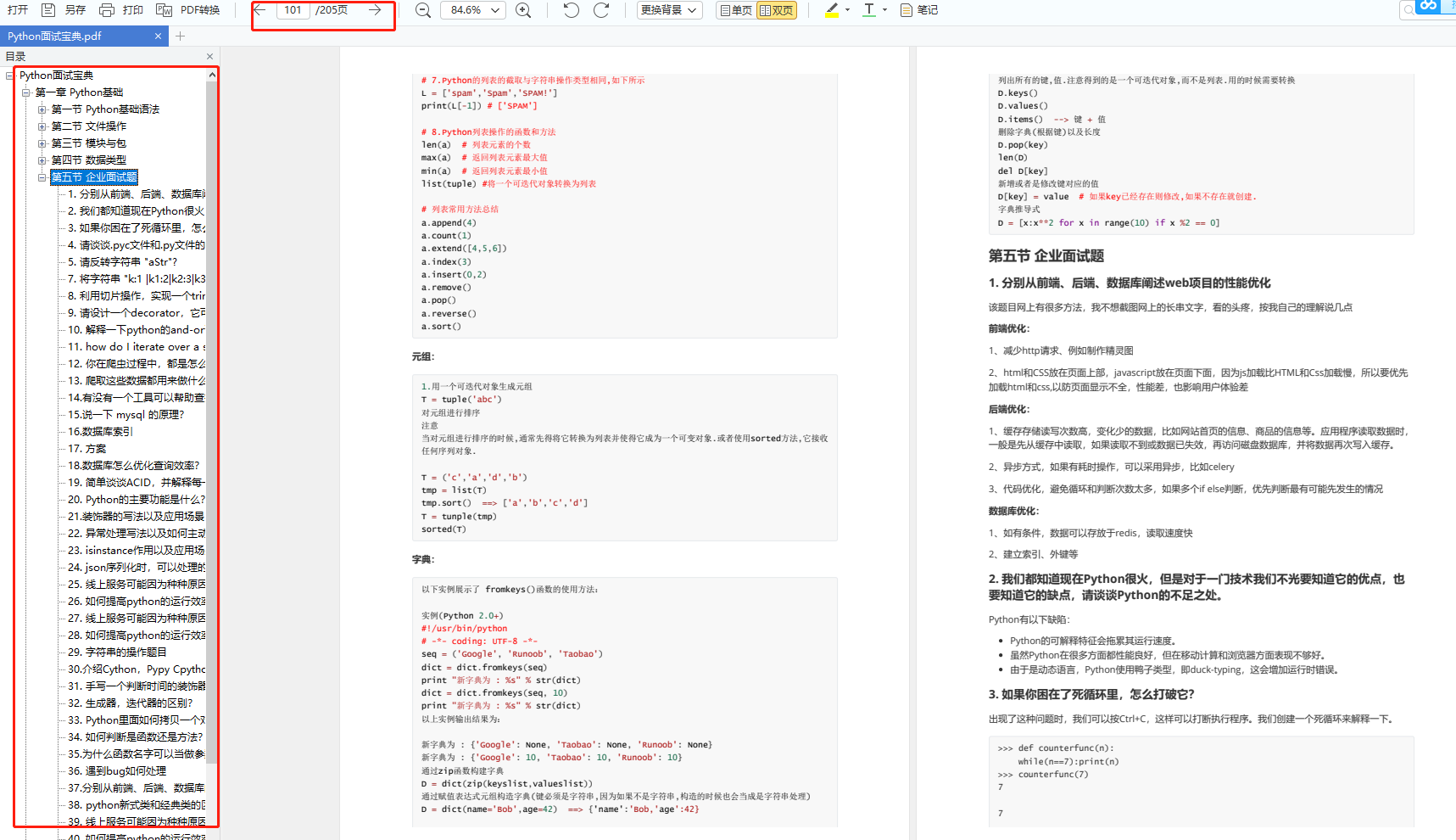

观看零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。 👉 四、实战案例 光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。(文末领读者福利) 👉五、Python练习题 检查学习结果。 👉六、面试资料 我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

👉因篇幅有限,仅展示部分资料,这份完整版的Python全套学习资料已经上传 网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。 需要这份系统化学习资料的朋友,可以戳这里无偿获取 一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长! |

【本文地址】

今日新闻 |

点击排行 |

|

推荐新闻 |

图片新闻 |

|

专题文章 |

👉三、Python视频合集

👉三、Python视频合集