| 机器学习之过拟合解决 | 您所在的位置:网站首页 › 过拟合怎么办 › 机器学习之过拟合解决 |

机器学习之过拟合解决

|

过拟合解决——早停法

一、早停法简介(Early Stopping)

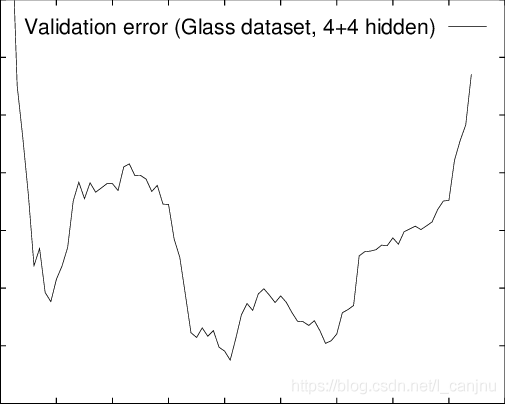

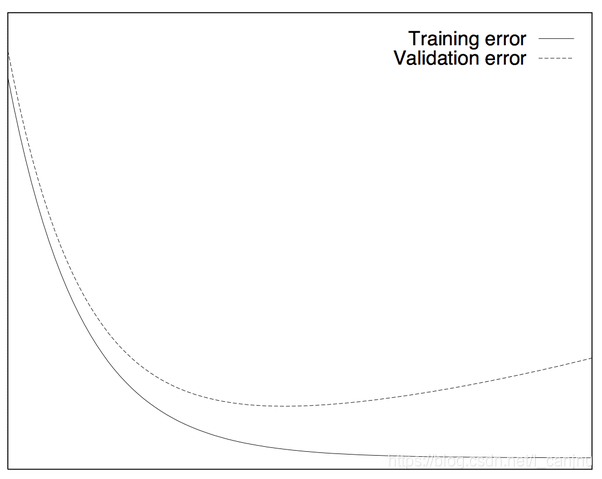

当我们训练深度学习神经网络的时候通常希望能获得最好的泛化性能(generalization performance,即可以很好地拟合数据)。但是所有的标准深度学习神经网络结构如全连接多层感知机都很容易过拟合:当网络在训练集上表现越来越好,错误率越来越低的时候,实际上在某一刻,它在测试集的表现已经开始变差。 模型的泛化能力通常使用模型在验证数据集(validation set)上的表现来评估。随着网络的优化,我们期望的理想中的泛化错误如图1所示。即当模型在训练集上的误差降低的时候,其在验证集上的误差表现不会变差。反之,当模型在训练集上表现很好,在验证集上表现很差的时候,我们认为模型出现了过拟合(overfitting)的情况。 解决过拟合问题有两个方向:降低参数空间的维度或者降低每个维度上的有效规模(effective size)。降低参数数量的方法包括greedy constructive learning、剪枝和权重共享等。降低每个参数维度的有效规模的方法主要是正则化,如权重衰变(weight decay)和早停法(early stopping)等。 早停法是一种被广泛使用的方法,在很多案例上都比正则化的方法要好。图1是我们经常看到论文中出现的图,也是使用早停法出现的一个结果。其基本含义是在训练中计算模型在验证集上的表现,当模型在验证集上的表现开始下降的时候,停止训练,这样就能避免继续训练导致过拟合的问题。其主要步骤如下: 将原始的训练数据集划分成训练集和验证集只在训练集上进行训练,并每个一个周期计算模型在验证集上的误差,例如,每15次epoch(mini batch训练中的一个周期)当模型在验证集上的误差比上一次训练结果差的时候停止训练使用上一次迭代结果中的参数作为模型的最终参数然而,在现实中,模型在验证集上的误差不会像上图那样平滑,而是像下图一样:

图2、真实的验证集误差变化曲线 也就是说,模型在验证集上的表现可能咱短暂的变差之后有可能继续变好。上图在训练集迭代到400次的时候出现了16个局部最低。其中有4个最低值是它们所在位置出现的时候的最低点。其中全局最优大约出现在第205次迭代中。首次出现最低点是第45次迭代。相比较第45次迭代停止,到第400次迭代停止的时候找出的最低误差比第45次提高了1.1%,但是训练时间大约是前者的7倍。 但是,并不是所有的误差曲线都像上图一样,有可能在出现第一次最低点之后,后面再也没有比当前最低点更低的情况了。所以我们看到,早停法主要是训练时间和泛化错误之间的权衡。尽管如此,也有某些停止标准也可以帮助我们寻找更好的权衡。 二、如何使用早停法我们需要一个停止的标准来实施早停法,因此,我们希望它可以产生最低的繁华错误,同时也可以有最好的性价比,即给定泛化错误下的最小训练时间 2.1、停止标准简介

一般情况下,“较慢”的标准会相对而言在平均水平上表现略好,可以提高泛化能力。然而,这些标准需要较长的训练时间。其实,总体而言,这些标准在系统性的区别很小。主要选择规则包括: 除非较小的提升也有很大价值,否则选择较快的停止标准为了最大可能找到一个好的方案,使用GL标准为了最大化平均解决方案的质量,如果网络只是过拟合了一点点,可以使用PQ标准,否则使用UP标准PS:早停法函数keras EarlyStopping()函数详解 |

【本文地址】

图1、理想中的训练集误差和验证集的误差

图1、理想中的训练集误差和验证集的误差