| HADOOP集群搭建, HDFS简易配置 | 您所在的位置:网站首页 › 虚拟机的静态ip地址统一设置为1921682588 › HADOOP集群搭建, HDFS简易配置 |

HADOOP集群搭建, HDFS简易配置

|

目录

概念:配置**需要配置静态ip**HDFS配置官网下载tar包,并上传tar包至服务器解压tar包进入配置文件路径,修改配置文件配置hadoop环境变量初始化集群启动配置

概念:

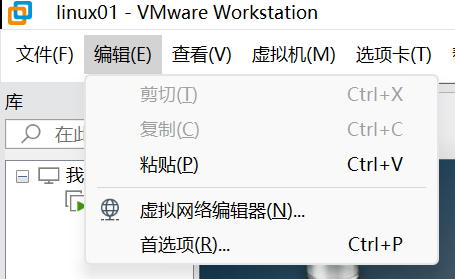

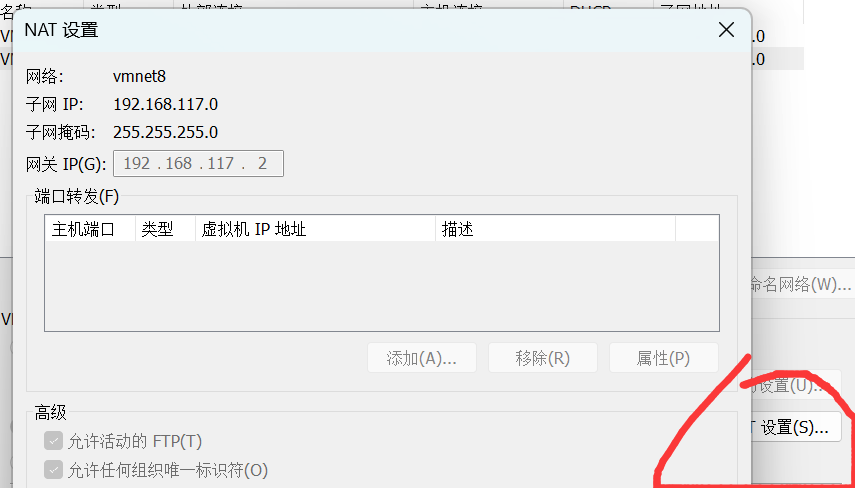

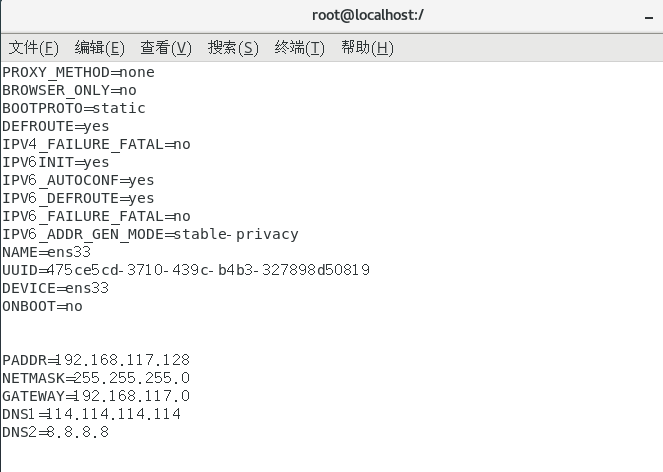

HADOOP在多计算机集群环境中营造一个统一而稳定的存储和计算环境。 Hadoop Distributed File System (HDFS) 主节点:Master NameNode 从结点:Slave DataNode 配置前提:安装好mysql和java环境 需要配置静态ip vim /etc/sysconfig/network-scripts/ifcfg-ens33把bootproto改为static 在最下面加入如下内容 IPADDR=192.168.70.100 这里修改为你的ip NETMASK=255.255.255.0 GATEWAY=192.168.70.2 这里修改为你的网关 DNS1=114.114.114.114 DNS2=8.8.8.8 ip和网关可以在如下地方查看

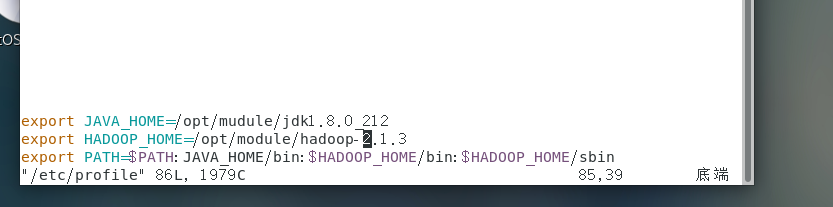

这样就ok了 HDFS配置 官网下载tar包,并上传tar包至服务器 解压tar包 tar -zxvf hadoop-3.1.3.tar.gz -C /opt/module 进入配置文件路径,修改配置文件 cd /opt/module/hadoop-3.1.3/etc/hadoop vim hadoop-env.sh配置Java环境 JAVA_HOME=/opt/module/jdk1.8.0_2122> vim core-site.xml在configuration添加内容 fs.defaultFS hdfs://192.168.70.100:9000 hadoop.tmp.dir /opt/module/hadoop-3.1.3/data hadoop.http.staticuser.user root hadoop.proxyuser.root.hosts * hadoop.proxyuser.root.groups * hadoop.proxyuser.root.groups *注意: hdfs://192.168.70.100:9000 ip需修改为你自己的 3> vim hdfs-site.xml增加如下内容 dfs.namenode.http-address 192.168.70.100:50070 dfs.namenode.secondary.http-address 192.168.70.100:50090 dfs.replication 1 配置hadoop环境变量 vim /etc/profile

初始化完成

配置ssh免密登录 cd /root ssh-keygen

分发钥匙 ssh-copy-id 192.168.117.128

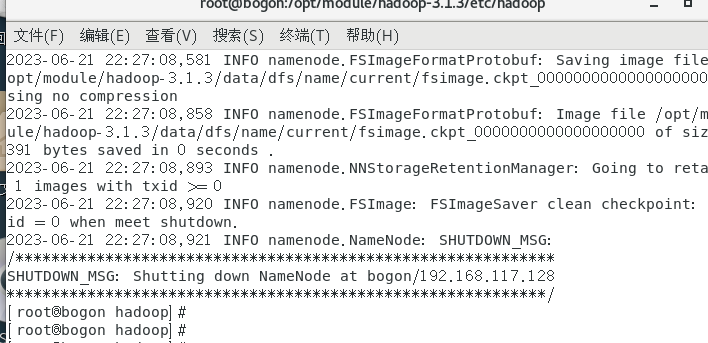

输入yes和密码 ssh-copy-id localhost启动Hadoop start-dfs.sh //此时应当在hadoop的目录注意:如果想root用户启动,需在配置文件添加如下内容 export HDFS_NAMENODE_USER=root export HDFS_DATANODE_USER=root export HDFS_SECONDARYNAMENODE_USER=root export YARN_RESOURCEMANAGER_USER=root export YARN_NODEMANAGER_USER=root后续依然要source source /etc/profile可以看到启动成功

访问web端也是正常打开

|

【本文地址】

公司简介

联系我们