| [机器学习] ML重要概念:梯度(Gradient)与梯度下降法(Gradient Descent) | 您所在的位置:网站首页 › 梯度下降算法是什么 › [机器学习] ML重要概念:梯度(Gradient)与梯度下降法(Gradient Descent) |

[机器学习] ML重要概念:梯度(Gradient)与梯度下降法(Gradient Descent)

|

引言

机器学习栏目记录我在学习Machine Learning过程的一些心得笔记,涵盖线性回归、逻辑回归、Softmax回归、神经网络和SVM等等,主要学习资料来自网上的免费课程和一些经典书籍,免费课程例如Standford Andrew Ng老师在Coursera的教程以及UFLDL Tutorial,经典书籍例如《统计学习方法》等,同时也参考了大量网上的相关资料(在后面列出)。 前言机器学习中的大部分问题都是优化问题,而绝大部分优化问题都可以使用梯度下降法处理,那么搞懂什么是梯度,什么是梯度下降法就非常重要!这是基础中的基础,也是必须掌握的概念! 提到梯度,就必须从导数(derivative)、偏导数(partial derivative)和方向导数(directional derivative)讲起,弄清楚这些概念,才能够正确理解为什么在优化问题中使用梯度下降法来优化目标函数,并熟练掌握梯度下降法(Gradient Descent)。 本文主要记录我在学习机器学习过程中对梯度概念复习的笔记,主要参考《高等数学》《简明微积分》以及维基百科上的资料为主,文章小节安排如下: 1)导数 2)导数和偏导数 3)导数与方向导数 4)导数与梯度 5)梯度下降法 6)参考资料 7)结语 导数 一张图读懂导数与微分: |

【本文地址】

这是高数中的一张经典图,如果忘记了导数微分的概念,基本看着这张图就能全部想起来。 导数定义如下:

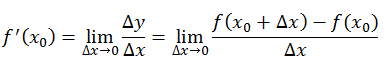

这是高数中的一张经典图,如果忘记了导数微分的概念,基本看着这张图就能全部想起来。 导数定义如下:  反映的是函数y=f(x)在某一点处沿x轴正方向的变化率。再强调一遍,是函数f(x)在x轴上某一点处沿着x轴正方向的变化率/变化趋势。直观地看,也就是在x轴上某一点处,如果f’(x)>0,说明f(x)的函数值在x点沿x轴正方向是趋于增加的;如果f’(x)

反映的是函数y=f(x)在某一点处沿x轴正方向的变化率。再强调一遍,是函数f(x)在x轴上某一点处沿着x轴正方向的变化率/变化趋势。直观地看,也就是在x轴上某一点处,如果f’(x)>0,说明f(x)的函数值在x点沿x轴正方向是趋于增加的;如果f’(x)