| DE–A Simple and Efficient Heuristic for Global Optimization over Continuous Spaces | 您所在的位置:网站首页 › 冰封王座十大经典 › DE–A Simple and Efficient Heuristic for Global Optimization over Continuous Spaces |

DE–A Simple and Efficient Heuristic for Global Optimization over Continuous Spaces

|

0、论文背景

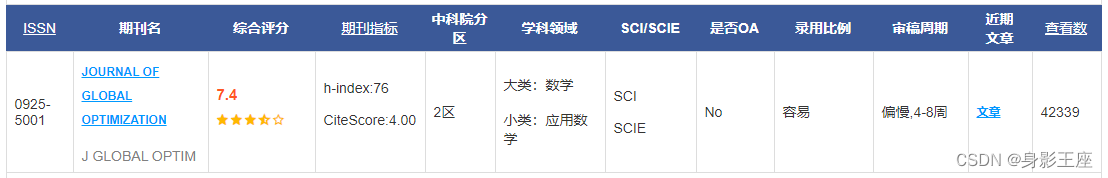

本文提出了一种新的最小化可能的非线性和不可微连续空间函数的启发式方法,即差分进化。 Storn R, Price K. Differential evolution–a simple and efficient heuristic for global optimization over continuous spaces[J]. Journal of global optimization, 1997, 11(4): 341-359.

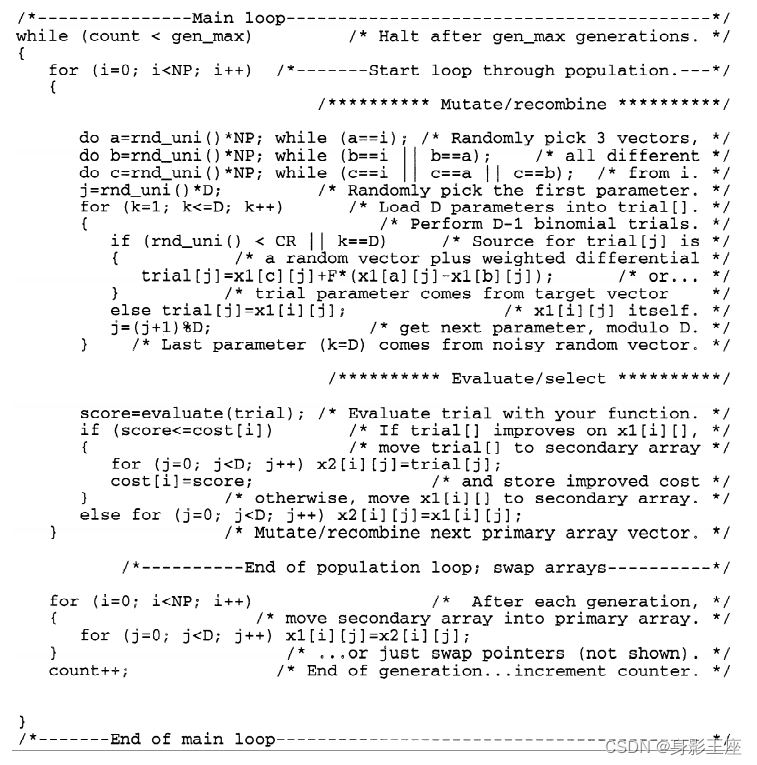

本文主要提出了差分进化,然后与其他全局优化算法进行比较,然后得出差分进化效果更好的结论。本文不做其他算法进行解读,主要解读的是差分进化。 用户通常要求一个实用的最小化技术应该满足五个要求: 能够处理不可微、非线性和多模态代价函数。并行地处理计算密集型成本函数。使用很少的控制变量来控制最小化。这些变量也是稳健的和易于选择的。良好的收敛性。 Differential evolution: 为了满足要求1,将DE设计为一种随机直接搜索方法。DE通过使用一个种群向量来满足要求2,其中种群向量的随机扰动可以独立地完成。DE的自组织方案利用两个随机选择的种群向量的差分向量来扰动一个现有的向量。对每个种群向量都进行了扰动。后续实验表明,DE在收敛性这一方面变现地非常好。 2、Differential evolution差分进化(DE)是一种利用NP个D维参数向量的并行直接搜索方法,G表示迭代次序。 DE通过将两个参数向量之间的加权差值加到第三个向量中来生成新的参数向量。让这个操作被称为突变。 突变向量的参数然后与另一个预定向量的参数混合,即目标向量,以产生所谓的试验向量。参数混合通常被称为“交叉”。如果试验向量产生的成本函数值低于目标向量,则试验向量将在下一代中替换目标向量。这最后一个操作被称为选择。上述操作一共进行NP次。 2.1 突变对于每一个向量: 生成一个突变向量:

r1、r2和r3选择为与i不同;F是[0,2]之间,主要是控制参数向量的突变程度。 还有一种形式: 当种群向量NP的数量足够高时,使用两个差分向量似乎可以提高种群的多样性。 2.2 交叉为了增加突变向量的多样性,引入了交叉的方法。得到试验向量: 试验向量通过如下方式获得: randb(j)是[0,1]之间随机生成的;CR是[0,1]之间的交叉常量; 图形的形象表示:

如果向量 整个算法的伪代码流程图:

|

【本文地址】