| CTF | 您所在的位置:网站首页 › ctf题目分类 › CTF |

CTF

|

1.直接查看源代码

(1)http://lab1.xseclab.com/base1_4a4d993ed7bd7d467b27af52d2aaa800/index.php (1) http://lab1.xseclab.com/base7_eb68bd2f0d762faf70c89799b3c1cc52/index.php

1. Referer来源伪造 例如:在 www.google.com 里有一个 www.baidu.com 超链接,当点击这个链接跳转到baidu的时候,浏览器向baidu发出的请求信息里就有:Referer=http://www.google.com 通过brup拦截,再使用Reapter修改Referer为想指定的URL 2. X-Forwarded-For:IP伪造 客户端向服务器发送请求时,会发送自己的IP地址 使用brup拦截请求包,在Proxy里面发送到Repeater,将Http头中的X-Forwarded-For改为想改的ip 例题 攻防世界web referer-xff

cookies是由网络服务器存储在你电脑硬盘上的一个txt类型的小文件,它和你的网络浏览行为有关,所以存储在你电脑上的cookies就好像你的一张身份证,你电脑上的cookies和其他电脑上的cookies是不一样的;cookies不能被视作代码执行,也不能成为病毒,所以它对你基本无害。 cookie可以在报文头的前面进行设置。

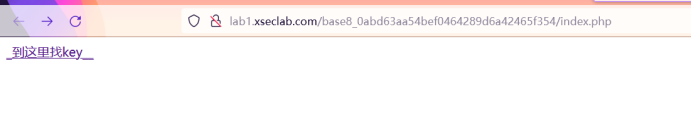

http://lab1.xseclab.com/base8_0abd63aa54bef0464289d6a42465f354/index.php

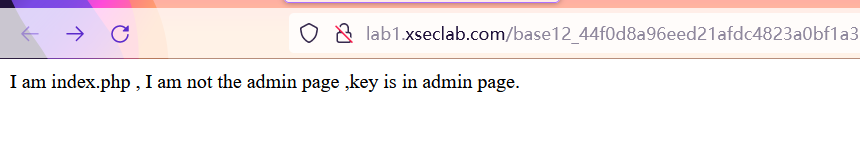

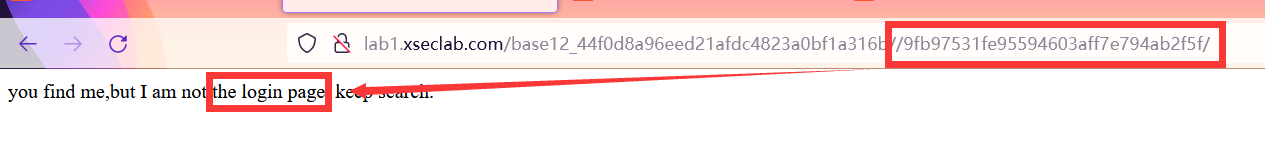

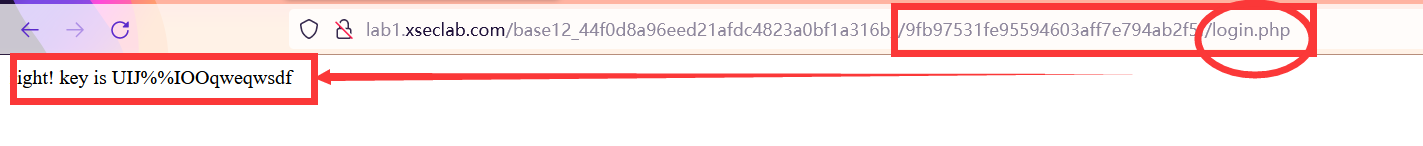

有关控制台的题目 6.javascript代码绕过利用Burp suite来拦截POST请求,通过修改HTTP请求来绕过前端的JavaScript验证,并成功地向服务器提交了敏感数据来造成XSS跨站漏洞。 前端JavaScript验证是为了防止用户输入错误,服务器端验证是为了防止恶意攻击。 7.robots.txt文件获取信息robots协议是网站跟爬虫间的协议,用简单直接的txt格式文本方式告诉对应的爬虫被允许的权限,也就是说robots.txt是搜索引擎中访问网站的时候要查看的第一个文件。当一个搜索蜘蛛访问一个站点时,它会首先检查该站点根目录下是否存在robots.txt,如果存在,搜索机器人就会按照该文件中的内容来确定访问的范围;如果该文件不存在,所有的搜索蜘蛛将能够访问网站上所有没有被口令保护的页面。 http://lab1.xseclab.com/base12_44f0d8a96eed21afdc4823a0bf1a316b/index.php bak文件 有些时候网站管理员可能为了方便,会在修改某个文件的时候先复制一份,将其命名为xxx.bak。而大部分Web Server对bak文件并不做任何处理,导致可以直接下载,从而获取到网站某个文件的源代码。 我们可以在一个文件的后面加上.bak后缀,从而通过这个文件直接查看一部分的源码 例题 攻防世界web基础题 9.js基础 10.HTML基础 11.PHP基础

https://www.ctfhub.com/#/skilltree 不会 攻防世界web基础题 1.webshell 2.command execution 一个是用中 国 菜 刀注木马 一个是要求ping命令及Linux 大概的考点: 考点详情1网页源码审计2查看或者修改http请求头3302跳转信息4查看开发者工具控制台5.Js代码查看和加密解密6Burp suite使用7Robots.txt8Aps,php代码审计9Sql注入10简单脚本使用11.后台登录12代码逆向13上传绕过14Hash函数15备份文件16验证码17Cookies18MD5碰撞19沙箱逃逸20源码泄露21反序列化22XXE实体漏洞sql注入 回显注入 报错注入 盲注 堆叠注入、header注入、cookie注入等 xss跨站脚本攻击 反射型 存储型 DOM csrf跨站请求伪造 文件相关 文件包含漏洞 文件上传 php相关 php反序列化 XXE SSRF 命令执行 其他 暴力破解 url重定向 信息搜集 |

【本文地址】

(2)http://ctf1.shiyanbar.com/basic/catch/ 没打开

(2)http://ctf1.shiyanbar.com/basic/catch/ 没打开

3.User-Agent:用户代理(就是用什么浏览器什么的) http://lab1.xseclab.com/base6_6082c908819e105c378eb93b6631c4d3/index.php

3.User-Agent:用户代理(就是用什么浏览器什么的) http://lab1.xseclab.com/base6_6082c908819e105c378eb93b6631c4d3/index.php  若时对.net的版本修改,后面添加,如版本9 .NET CLR 9 4.Accept-Language:语言 http://lab1.xseclab.com/base1_0ef337f3afbe42d5619d7a36c19c20ab/index.php http://ctf1.shiyanbar.com/basic/header/

若时对.net的版本修改,后面添加,如版本9 .NET CLR 9 4.Accept-Language:语言 http://lab1.xseclab.com/base1_0ef337f3afbe42d5619d7a36c19c20ab/index.php http://ctf1.shiyanbar.com/basic/header/ 5.Cookie的修改

5.Cookie的修改

查看源代码

查看源代码